Faut-il un PC surpuissant pour faire de l'IA en 2026 ? (Guide d'achat complet)

GPU, RAM, processeur : décryptage des vrais besoins matériels pour l'IA générative en 2026. Ce guide d'achat vous évite les erreurs coûteuses et vous montre exactement quoi acheter selon votre usage.

Vous êtes là, devant une page de configurateur PC, paralysé. RTX 4090 ? RTX 4070 ? Combien de RAM ? Est-ce que votre portable de 2021 peut encore servir ? Les forums vous crient qu'il faut 24 Go de VRAM minimum. Les vendeurs vous poussent vers des configs à 3000 euros. Et pendant ce temps, vous n'avez toujours pas généré votre première image.

Stop.

Prenez une grande respiration. La réponse à "faut-il un PC surpuissant pour l'IA" dépend d'une seule chose : ce que vous comptez réellement faire. Et pour 80 % des débutants, la réponse va vous surprendre.

Pour aller plus loin avec une demonstration pratique, cette video est directement liee au sujet.

ChatGPT Atlas le FLOP : ce navigateur veut remplacer Google ? Test complet

Le grand malentendu sur le matériel IA

Voici ce que personne ne vous dit clairement : la majorité des outils d'IA générative fonctionnent dans le cloud. Quand vous utilisez ChatGPT, Midjourney, DALL·E, Runway, Sora, ou ElevenLabs, votre ordinateur ne fait qu'une chose : afficher une page web. C'est tout. Le calcul lourd, celui qui demande des GPU monstrueux, se passe sur les serveurs d'OpenAI, de Google, ou de Runway. Pas chez vous.

Pensez-y comme regarder Netflix. Votre télé n'a pas besoin d'être un super-calculateur pour afficher un film en 4K. Elle reçoit juste un flux vidéo. Même principe ici.

Alors pourquoi tout ce bruit autour des configs gaming surpuissantes ? Parce qu'il existe un autre monde : celui de l'IA locale. Stable Diffusion installé sur votre machine. Des modèles de langage qui tournent sans connexion internet. Des workflows ComfyUI qui enchaînent des dizaines d'étapes de génération. Là, oui, votre matériel compte. Beaucoup.

La vraie question n'est pas "faut-il un PC puissant pour l'IA" mais "est-ce que je veux faire de l'IA locale ?"

Scénario 1 : Vous débutez et voulez simplement créer

Prenons Marine, graphiste freelance. Elle veut utiliser l'IA pour accélérer ses moodboards, générer des visuels d'ambiance, et créer des voix off pour ses présentations clients. Son budget matériel : le moins possible.

Ce dont Marine a réellement besoin :

- Un ordinateur capable d'ouvrir un navigateur moderne (Chrome, Firefox, Edge)

- 8 Go de RAM (4 Go passent, mais c'est serré avec plusieurs onglets)

- Une connexion internet stable

- C'est tout.

Marine peut utiliser Midjourney via Discord, générer des images avec DALL·E 3, créer des vidéos avec Luma Dream Machine, produire des voix off avec ElevenLabs, et rédiger avec Claude. Tout ça sur son MacBook Air de 2019. Aucune mise à niveau nécessaire.

Investissement réel pour Marine : 0 euro en matériel. Elle paie des abonnements aux services (20 à 100 euros par mois selon ses besoins), pas du hardware.

Scénario 2 : Vous voulez de l'indépendance et du contrôle

Maintenant, Thomas. Réalisateur indépendant, il veut :

- Générer des images sans payer d'abonnement mensuel

- Ne pas dépendre de serveurs qui peuvent tomber ou censurer ses prompts

- Avoir un contrôle total sur les paramètres de génération

- Travailler hors ligne quand il est en tournage

Thomas a besoin de faire tourner Stable Diffusion en local. Et là, les règles changent complètement.

Ce dont Thomas a réellement besoin :

- Un GPU NVIDIA avec minimum 8 Go de VRAM (idéal : 12 Go ou plus)

- 32 Go de RAM système

- Un SSD de 1 To minimum (les modèles sont lourds)

- Un processeur récent (pas critique, mais aide)

Pour Thomas, un PC à 1500-2000 euros devient pertinent. Mais attention : c'est un investissement pour de la production locale intensive, pas pour "utiliser l'IA".

Le tableau qui clarifie tout

| Usage | Matériel nécessaire | Budget indicatif | Exemples d'outils |

|---|---|---|---|

| Assistants texte (ChatGPT, Claude, Gemini) | N'importe quel PC/Mac avec navigateur | 0 € (matériel existant) | ChatGPT, Claude, Gemini, Perplexity |

| Génération d'images en ligne | Idem | 0 € | Midjourney, DALL·E 3, Ideogram, Leonardo |

| Génération vidéo en ligne | Idem | 0 € | Runway, Luma, Sora, Kling |

| Synthèse vocale en ligne | Idem | 0 € | ElevenLabs, PlayHT |

| Stable Diffusion local (basique) | GPU 8 Go VRAM, 16 Go RAM | 800-1200 € | Automatic1111, Fooocus |

| Stable Diffusion local (avancé) | GPU 12-24 Go VRAM, 32 Go RAM | 1500-3000 € | ComfyUI, workflows complexes |

| LLM locaux (Llama, Mistral) | GPU 16-24 Go VRAM, 64 Go RAM | 2000-4000 € | Ollama, LM Studio |

| Entraînement de modèles | GPU 24 Go+ VRAM, 128 Go RAM | 3000 €+ ou cloud | Fine-tuning, LoRA |

Les composants qui comptent vraiment (et ceux qui ne servent à rien)

Le GPU : le roi absolu de l'IA locale

Si vous faites de l'IA locale, c'est le composant. Pas le processeur. Pas la RAM système. Le GPU.

Pourquoi ? Parce que les réseaux de neurones sont massivement parallélisables. Un GPU contient des milliers de petits cœurs de calcul qui travaillent simultanément. Un processeur, même haut de gamme, n'a que quelques dizaines de cœurs. La différence de performance est abyssale.

Ce qui compte dans un GPU pour l'IA :

- La VRAM (mémoire vidéo) : C'est la stat la plus critique. Les modèles doivent tenir entièrement en VRAM. Pas assez de VRAM = impossible de charger le modèle, ou performances catastrophiques.

- L'architecture NVIDIA : Les bibliothèques d'IA (PyTorch, CUDA) sont optimisées pour NVIDIA. AMD et Intel progressent, mais le support est encore bancal.

- La génération de la carte : Une RTX 3060 12 Go peut battre une RTX 4070 8 Go pour l'IA. Contre-intuitif, mais logique : plus de VRAM l'emporte.

Le classement concret en 2026 :

| GPU | VRAM | Prix neuf (indicatif) | Verdict |

|---|---|---|---|

| RTX 4090 | 24 Go | ~1800 € | Le top absolu, overkill pour débuter |

| RTX 4080 Super | 16 Go | ~1100 € | Excellent équilibre puissance/VRAM |

| RTX 4070 Ti Super | 16 Go | ~850 € | Sweet spot pour Stable Diffusion avancé |

| RTX 4060 Ti 16 Go | 16 Go | ~500 € | Bon rapport qualité/prix, assez lent |

| RTX 3060 12 Go | 12 Go | ~300 € (occasion) | Le choix budget, encore très capable |

| RTX 4060 8 Go | 8 Go | ~300 € | Éviter, VRAM insuffisante |

Règle d'or : préférez toujours plus de VRAM à plus de puissance brute. Une RTX 3060 12 Go vous emmènera plus loin qu'une RTX 4070 8 Go pour l'IA générative.

La RAM système : 32 Go, le nouveau standard

La RAM (mémoire vive de l'ordinateur, pas du GPU) joue un rôle souvent sous-estimé. Quand vous générez une image avec Stable Diffusion, votre système doit :

- Charger l'interface (ComfyUI, Automatic1111)

- Gérer les fichiers temporaires

- Stocker les images générées en mémoire

- Parfois faire des calculs CPU en parallèle

Avec 16 Go, ça passe pour du basique. Mais dès que vous ouvrez Chrome à côté, lancez un second logiciel, ou utilisez des workflows complexes, vous allez souffrir. Votre système va utiliser le disque dur comme extension de mémoire (swap), et tout va ralentir dramatiquement.

Ma recommandation concrète :

- Minimum absolu : 16 Go DDR4 ou DDR5

- Confortable : 32 Go

- Workflows lourds / multi-applications : 64 Go

La bonne nouvelle : la RAM est le composant le plus facile et le moins cher à upgrader. Vous pouvez commencer avec 16 Go et ajouter des barrettes plus tard.

Le processeur : important, mais pas critique

Contrairement à ce que suggèrent les configs gaming, le processeur (CPU) n'est pas le bottleneck pour l'IA générative. Le GPU fait le gros du travail. Le CPU se contente de :

- Charger les modèles depuis le disque

- Préparer les données avant de les envoyer au GPU

- Gérer l'interface utilisateur

Un processeur milieu de gamme récent suffit largement. Un Intel Core i5-12400 ou un AMD Ryzen 5 5600 font très bien le job. Inutile de viser un i9 ou un Ryzen 9 sauf si vous faites aussi du montage vidéo lourd ou du rendu 3D.

Le stockage : SSD obligatoire, NVMe recommandé

Les modèles d'IA sont volumineux. Un checkpoint Stable Diffusion pèse entre 2 et 7 Go. Les modèles de langage peuvent dépasser 30 Go. Et vous allez en accumuler plusieurs.

Un disque dur mécanique (HDD) rend l'expérience pénible. Chargement des modèles interminable. Écriture des images lente. Swap insupportable.

Configuration stockage recommandée :

- SSD NVMe 1 To pour le système et les logiciels

- SSD SATA ou NVMe 2 To pour les modèles et les outputs (peut être ajouté après)

Les SSD NVMe sont désormais très abordables. Comptez 80-100 euros pour 1 To de bonne qualité.

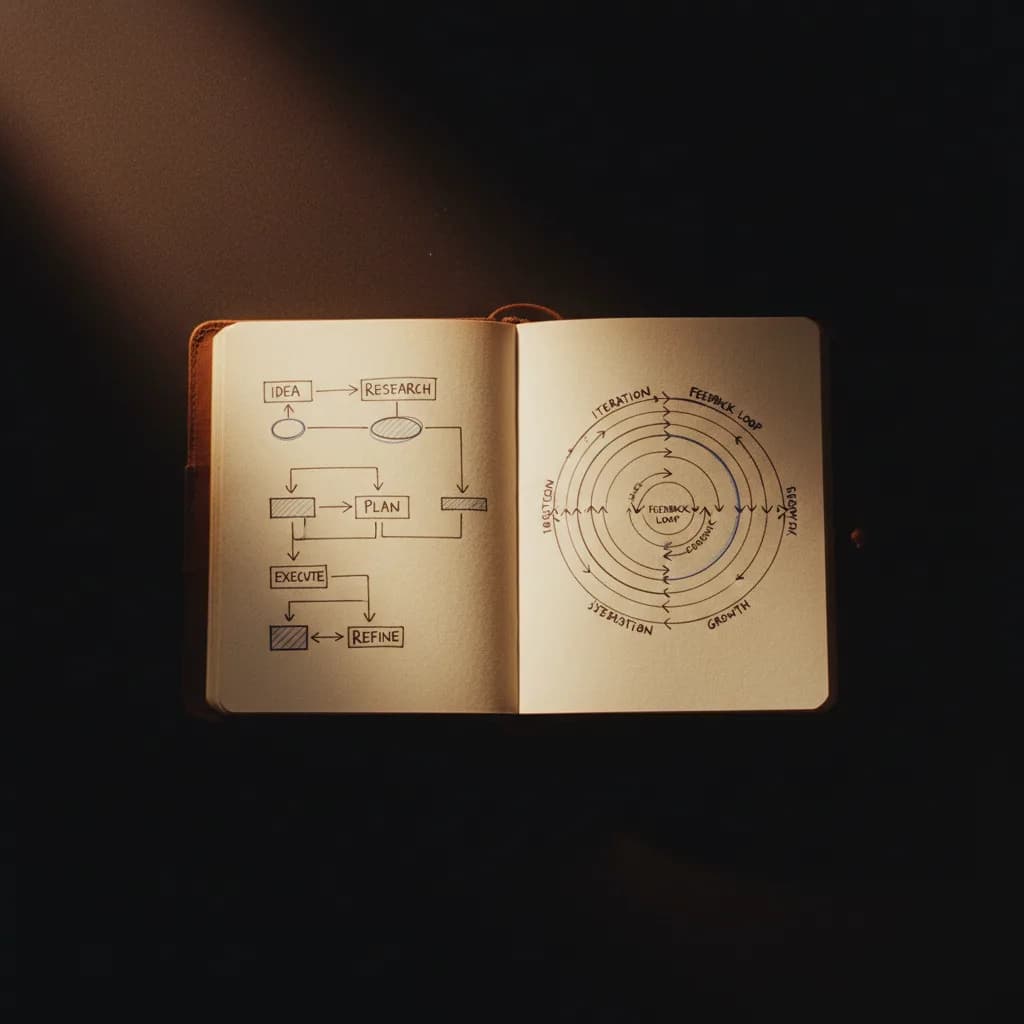

La section "guerre des tranchées" : ce que les débutants font mal

Erreur 1 : Acheter du matériel avant d'avoir essayé

C'est l'erreur classique. Quelqu'un lit un article sur Stable Diffusion, s'enflamme, achète une config à 2000 euros, et réalise trois semaines plus tard qu'il préfère Midjourney parce que c'est plus simple. Le PC gaming prend la poussière.

La correction : Commencez par les outils cloud. Midjourney, Leonardo AI, Fooocus en ligne (huggingface.co/spaces/lllyasviel/Fooocus). Utilisez-les pendant un mois minimum. Si vous vous retrouvez constamment limité par les quotas, la censure, ou le manque de contrôle, alors envisagez le local.

Erreur 2 : Sous-estimer la VRAM, surestimer tout le reste

"J'ai pris une RTX 4070 parce qu'elle est plus récente que la 3060." Erreur fatale. La 4070 standard a 12 Go de VRAM. La 3060 aussi. Mais la 4070 coûte le double. Pour de l'IA pure, vous venez de payer 300 euros de plus pour des performances quasi-identiques sur Stable Diffusion.

La correction : Regardez d'abord la VRAM, puis le prix, puis les performances brutes. Dans cet ordre. Toujours.

Erreur 3 : Ignorer le coût des abonnements cloud

"Je refuse de payer 20 euros par mois pour Midjourney, je préfère avoir mon propre setup." Calculons. Une config pour Stable Diffusion local confortable coûte environ 1500 euros. Divisé par 20 euros mensuels, ça représente 75 mois, soit plus de 6 ans d'abonnement Midjourney.

Et Midjourney vous donne :

- Zéro maintenance

- Des mises à jour automatiques

- Pas de problèmes de drivers

- Pas de temps perdu à configurer

La correction : Le local a des avantages réels (contrôle, confidentialité, indépendance). Mais l'argument économique ne tient pas pour la plupart des utilisateurs. Soyez honnête sur vos vraies motivations.

Erreur 4 : Négliger l'alimentation électrique

Une RTX 4080 peut tirer 320 watts en pic. Ajoutez le processeur, les disques, la carte mère : 500-600 watts au total. Si votre alimentation (PSU) fait 450 watts, vous allez avoir des plantages aléatoires, des redémarrages, voire des dégâts matériels.

La correction : Prenez une alimentation de qualité (80+ Gold minimum) avec 150-200 watts de marge au-dessus de votre consommation estimée. Pour une config avec RTX 4070, visez 650 watts. Pour une RTX 4080/4090, visez 850 watts minimum.

Erreur 5 : Oublier le refroidissement

Les GPU IA tournent à pleine charge pendant des minutes, parfois des heures. Ce n'est pas comme le gaming où l'utilisation fluctue. Si votre boîtier n'a qu'un ventilateur en façade, votre carte graphique va throttle (réduire ses performances pour éviter la surchauffe).

La correction : Boîtier avec bon flux d'air. Minimum 2 ventilateurs en entrée, 1 en sortie. Les boîtiers "mesh" (façade perforée) sont idéaux. Et ne mettez pas votre PC dans un meuble fermé.

Trois configurations concrètes pour 2026

Config "Je débute, budget serré" (~900 euros)

| Composant | Modèle | Prix |

|---|---|---|

| GPU | RTX 3060 12 Go (occasion) | 250 € |

| CPU | Intel i5-12400F | 150 € |

| Carte mère | B660 basique | 100 € |

| RAM | 32 Go DDR4-3200 | 80 € |

| SSD | 1 To NVMe | 80 € |

| Alimentation | 650W 80+ Gold | 80 € |

| Boîtier | Mesh aéré | 60 € |

| Total | ~900 € |

Cette config fait tourner Stable Diffusion SDXL, la plupart des LoRA, et des workflows ComfyUI modérés. Elle ne fera pas de l'upscaling 4K ni des modèles géants, mais c'est une base solide.

Config "Sweet spot" (~1600 euros)

| Composant | Modèle | Prix |

|---|---|---|

| GPU | RTX 4070 Ti Super 16 Go | 850 € |

| CPU | AMD Ryzen 5 7600 | 200 € |

| Carte mère | B650 | 150 € |

| RAM | 32 Go DDR5-5600 | 120 € |

| SSD | 2 To NVMe | 130 € |

| Alimentation | 750W 80+ Gold | 100 € |

| Boîtier | Mesh avec 3 ventilateurs | 80 € |

| Total | ~1630 € |

Le sweet spot actuel. 16 Go de VRAM permettent de charger les modèles les plus exigeants. Assez rapide pour des générations en batch. Prêt pour les évolutions à venir.

Config "Production intensive" (~2800 euros)

| Composant | Modèle | Prix |

|---|---|---|

| GPU | RTX 4090 24 Go | 1800 € |

| CPU | AMD Ryzen 7 7800X3D | 350 € |

| Carte mère | X670 | 200 € |

| RAM | 64 Go DDR5-6000 | 200 € |

| SSD | 2 To NVMe Gen4 | 150 € |

| Alimentation | 1000W 80+ Platinum | 180 € |

| Boîtier | Full tower airflow | 120 € |

| Total | ~3000 € |

Pour les professionnels qui génèrent des centaines d'images par jour, font de l'upscaling vidéo IA, ou entraînent des LoRA personnalisés. Overkill pour 95 % des utilisateurs.

L'alternative souvent ignorée : le GPU cloud

Il existe une voie médiane entre "tout en ligne" et "PC surpuissant chez moi". Ce sont les services de GPU cloud comme RunPod, Vast.ai, ou Google Colab.

Le principe : vous louez un GPU puissant pendant quelques heures, à la demande. Vous payez uniquement le temps d'utilisation. Une RTX A6000 avec 48 Go de VRAM peut coûter moins de 1 euro de l'heure.

Quand c'est pertinent :

- Vous avez besoin de puissance occasionnellement (entraînement de LoRA, gros batches)

- Vous ne voulez pas investir 2000 euros d'un coup

- Vous voulez tester des configs surpuissantes avant d'acheter

Quand ce n'est pas pertinent :

- Vous générez tous les jours pendant plusieurs heures

- Votre connexion internet est instable

- Vous tenez à la confidentialité absolue de vos données

Pour aller plus loin sur cette option, consultez notre article dédié sur les GPU cloud et quand les utiliser.

Ma recommandation finale (sans langue de bois)

Si vous lisez cet article parce que vous hésitez encore, voici mon conseil direct :

Commencez avec ce que vous avez. Passez un mois sur Midjourney, Leonardo, ChatGPT. Voyez si l'IA vous plaît vraiment, si vous y revenez, si ça devient un outil quotidien.

Si après un mois vous êtes accro et que les limites vous frustrent (quotas, censure, manque de contrôle), alors posez-vous la question du local. Et dans ce cas, visez la config "sweet spot" à 1600 euros. Ni plus, ni moins. Elle fera le job pendant 3-4 ans minimum.

Si vous avez un budget serré, la RTX 3060 12 Go en occasion reste une porte d'entrée fantastique. Vous serez surpris de ce qu'elle peut faire.

Si vous n'avez pas de frustration avec les outils cloud, n'achetez rien. Vous n'avez pas besoin d'un PC surpuissant pour faire de l'IA en 2026. La plupart des créateurs professionnels utilisent Midjourney et Runway sans jamais toucher au local.

L'IA n'est pas une course à l'armement. C'est un outil. Choisissez celui qui correspond à vos besoins réels, pas à ce que les forums vous disent d'acheter.

Foire aux questions

Mon PC portable de 2020 peut-il faire de l'IA ?

Pour les outils cloud (Midjourney, ChatGPT, Runway), oui, sans problème. Pour Stable Diffusion local, ça dépend de votre GPU. Les GPU de laptops ont généralement moins de VRAM et sont moins performants. Un laptop avec RTX 3060 Mobile (6 Go VRAM) sera très limité. Vérifiez les specs exactes de votre machine.

AMD ou NVIDIA pour l'IA ?

NVIDIA, sans hésiter. L'écosystème IA (CUDA, PyTorch, TensorRT) est bâti autour de NVIDIA. AMD rattrape son retard avec ROCm, mais le support reste incomplet et la documentation plus rare. Sauf si vous êtes développeur prêt à débugger, restez sur NVIDIA.

Faut-il attendre les prochaines cartes graphiques ?

L'éternelle question. Les RTX 50xx arrivent, mais leur disponibilité et leurs prix réels restent incertains. Si vous avez besoin d'un PC maintenant, achetez maintenant. La config sweet spot d'aujourd'hui restera pertinente pendant des années. L'attente perpétuelle ne génère aucune image.

Est-ce que 8 Go de VRAM suffisent ?

Pour du Stable Diffusion basique (SD 1.5, petites résolutions), oui. Pour SDXL, les LoRA complexes, ou les workflows ComfyUI avancés, non. Vous allez constamment jongler avec les paramètres pour rester dans les limites. Ma recommandation : 12 Go minimum, 16 Go pour être tranquille.

Puis-je utiliser plusieurs GPU ?

Techniquement oui, mais le support multi-GPU pour l'IA générative est limité. La plupart des interfaces (Automatic1111, ComfyUI) n'exploitent qu'une seule carte à la fois. Mieux vaut une grosse carte qu'une deux petites.

Quel est l'impact sur ma facture d'électricité ?

Une RTX 4080 qui tourne 4 heures par jour consomme environ 40 kWh par mois, soit 8-10 euros selon votre tarif. C'est non négligeable mais rarement un facteur décisif. L'abonnement Midjourney coûte davantage.

Comment savoir si mon alimentation actuelle suffit ?

Additionnez la consommation max de votre GPU (TDP sur la fiche technique) + 200W pour le reste du système. Si votre alimentation actuelle dépasse ce total de 100W, vous êtes bon. Sinon, changez-la avant d'installer un nouveau GPU.

Est-ce que je peux upgrader mon PC actuel plutôt que d'en acheter un neuf ?

Souvent oui. Si vous avez un PC de bureau avec un slot PCIe x16 libre et une alimentation suffisante, ajouter une RTX 3060 ou 4070 peut suffire. Vérifiez aussi que votre carte mère accepte la taille physique de la carte (elles sont longues) et que votre boîtier a assez d'espace.

Votre avis

Chargement…

Sur le même thème sur ce site

Ces guides prolongent l’article sans répéter le même angle. Ils renforcent le maillage interne et aident à explorer le sujet en profondeur.

- Guide complet pour débuter en IA

- Visibilité sur ChatGPT, Search et Perplexity

- GEO vs SEO, différences clés

- Maillage interne pour un site de formation

Sources et cadre officiel (lectures externes)

Renseignements généraux, droit et bonnes pratiques publiés par des institutions. À consulter selon votre situation et votre juridiction.

Frank Houbre - expert IA vidéo et Image

Frank Houbre est un expert en IA vidéo et image, artiste IA et filmmaker récompensé aux Seoul International AI Film Festival et aux Mondial Chroma Awards. Avec plus de 10 ans d'expérience en entrepreneuriat digital, il crée des courts-métrages et animés entièrement générés par IA (Midjourney, Kling, Adobe Firefly). Co-Fondateur de Screenweaver et de la communauté #AIStudios, il partage des tutoriels gratuits et avis d'outils sur Business Dynamite pour aider les créateurs à automatiser leur production.

Continuer la lecture

Le guide complet pour bien débuter avec l'intelligence artificielle

Guide complet pour débutants en IA : par où commencer, quels outils utiliser, comment apprendre efficacement. Tout ce qu'il faut savoir pour se lancer.

L'IA pour les vrais débutants : le guide complet pour tout comprendre de A à Z

De la première définition à l'usage au quotidien : tout ce qu'un vrai débutant doit savoir sur l'IA, sans jargon ni fausses promesses.

Apprendre l'IA en 2026 , Le Guide Ultime Sans Jargon pour Particuliers

Guide complet pour apprendre l'IA sans jargon : premiers pas, outils accessibles et réflexes à prendre quand on est particulier ou débutant.

Guide pas à pas , le chemin pour devenir "Prompt Engineer" autodidacte

Pas de diplôme requis : méthode concrète pour maîtriser la formulation des prompts (texte, image) et vous positionner comme capable de piloter l'IA en pro.

Le Méga-Guide 2026 de l'intelligence artificielle générative

Tout ce qu'il faut savoir sur l'IA générative en 2026 : définitions, outils, workflows concrets et pièges à éviter pour les débutants qui veulent produire du contenu (texte, image, son, vidéo) comme un pro.

L'ingénierie de prompt (Prompt Engineering) pour les nuls : le guide de démarrage

Prompt engineering sans jargon : ce que c'est, pourquoi ça compte, et les premières techniques à utiliser tout de suite. Pour les vrais débutants.