Génération d'images par lots (Batch prompting) pour les agences de publicité

Produire des dizaines de visuels cohérents pour une campagne : structure des prompts, variables, style reference et pipelines pour les agences.

Une campagne, c’est rarement une image. C’est 20 bannières, 10 posts, 5 déclinaisons produit, un moodboard de 15 visuels. Faire chaque prompt à la main, un par un, fait perdre du temps et introduit des incohérences : une image avec « golden hour », l’autre avec « soft light » sans précision, et la série ne matche plus. Le batch prompting , générer en lots avec une structure commune et des variables , est la façon pro de garder la cohérence tout en variant le contenu. Ce guide couvre la structure des prompts, l’usage de la style reference, les variables à faire tourner et les pièges à éviter en agence.

Pour aller plus loin avec une demonstration pratique, cette video est directement liee au sujet.

Générer des Images IA : Le Guide COMPLET pour Débuter

Pourquoi le batch n’est pas « le même prompt 20 fois »

Si tu copies-colle le même prompt et que tu changes juste un mot (le produit, le personnage), tu obtiens des images proches mais pas forcément cohérentes : le modèle peut interpréter légèrement différemment à chaque fois (lumière, palette, grain). Pour une vraie série, il faut : (1) un squelette de prompt fixe (lumière, style, cadrage type, ratio), (2) une variable (sujet, action, produit), (3) idéalement une style reference (--sref ou équivalent) à partir d’une image validée. Comme en structurant un prompt, l’ordre et les termes techniques doivent être identiques sur tout le lot ; seul le bloc « sujet / action » change.

Pour la génération de visuels publicitaires cohérents de l’idée à l’export, le batch est l’étape de production ; le moodboard et le style guide en amont définissent le squelette.

Structure type d’un prompt de batch

Squelette (inchangé sur tout le lot).

« [LUMIÈRE], [CADRAGE TYPE], [FOCALE], cinematic stills, cinema photography, film grain, [PALETTE], no text. »

Variable (une par image).

« [SUJET], [ACTION ou état]. »

Exemple.

Squelette : « Soft key from left, warm, medium shot, 85mm, cinematic stills, cinema photography, film grain, muted colors, no text. »

Image 1 : « Woman in red dress, standing in rain ».

Image 2 : « Man in suit, walking in street ».

Image 3 : « Car in urban night, neon reflections ».

Chaque prompt final = Variable + Squelette (ou Squelette en premier selon la logique de ton outil ; sur Midjourney, le sujet en début pèse plus, donc Variable + Squelette).

Pour une style reference, tu génères une image avec ce format, tu la valides, puis tu l’utilises en --sref pour tout le reste du lot. Les nouvelles images tirent vers cette esthétique ; tu ne changes que la variable.

Workflow en 6 étapes pour une campagne

-

Définir le style guide.

Lumière (une phrase : « soft key left, warm, rim right cool »), palette (muted, warm, etc.), cadrage type (medium shot, 85mm), ratio (16:9 ou 1:1). Note-le dans un doc. C’est ton squelette pour les mois à venir sur cette campagne. -

Générer 1 à 3 images de référence.

Avec le squelette + une variable (ex. « Woman, direct gaze, neutral background »). Itérer jusqu’à avoir une image validée client ou interne. -

Déclarer cette image en style reference.

--sref (Midjourney) ou équivalent (Flux, SD). Toutes les prochaines générations du lot utiliseront cette ref. -

Lister les variables.

Tableur ou liste : une ligne = une image. Colonne « Sujet », colonne « Action ». Ex. : Sujet = « Product A on marble », Action = « top view ». Sujet = « Product B in hand », Action = « close-up ». -

Construire les prompts en masse.

Pour chaque ligne : Variable (sujet + action) + Squelette. Pas de changement dans le squelette (même ordre, mêmes mots). Coller dans un script, une macro ou un outil de batch si ton générateur le permet.

6. Lancer le lot et contrôler.

Générer. Vérifier la cohérence (lumière, couleurs, grain). Si une image dérive, vérifier qu’elle utilise bien le même squelette et la même --sref ; sinon régénérer ou corriger la variable (éviter les termes qui « tirent » vers un autre style).

Pour le moodboard professionnel pour convaincre l’agence, ce même squelette peut servir à produire les planches de préparation.

Scénarios concrets

Scénario 1 , 15 visuels pour une marque lifestyle.

Même lumière (golden hour, soft), même palette (warm, muted), 15 situations (personne à la plage, en ville, au café…). Workflow : Squelette unique. 15 variables (une par situation). Une image validée en --sref. Lancer les 15 avec le même --sref et le même squelette. Résultat : série homogène.

Scénario 2 , 10 packshots produit, même fond.

Même éclairage (soft key top left, fond noir), 10 produits différents. Workflow : Squelette : « On black surface, single soft key top left, 85mm, cinematic stills, no text ». Variable : « [Nom produit], centered ». Pas de personnage ; la cohérence vient du fond et de la lumière. Pour des mockups produits hyper-réalistes, tu peux ajouter des détails (reflets, ombre) dans le squelette.

Scénario 3 , Bannières web 5 formats.

Même visuel décliné en 16:9, 1:1, 9:16, etc. Workflow : Générer une composition en 16:9 (ou le format principal). Pour les autres ratios, regénérer avec le même prompt mais --ar différent (pas juste recadrer) pour que la composition soit adaptée à chaque format. Voir ratio d’aspect et narration. Le squelette reste le même ; la variable peut être « same scene, 1:1 composition » ou « same scene, 9:16 vertical » selon comment l’outil gère le ratio.

Ce que les débutants se trompent

Changer un mot dans le squelette entre deux images.

« Soft key » sur une image, « warm key » sur l’autre = petite différence qui peut casser la cohérence. Correction : Squelette copié-collé ; seule la variable change.

Trop de variables en une fois.

« Woman in red, in Paris, at night, with umbrella, rain » : trop de dimensions. Correction : Une ou deux dimensions variables (ex. « Woman in red » + « in rain ») ; le reste (lieu, nuit) peut être dans le squelette si c’est commun à tout le lot.

Pas de style reference.

Sans --sref, même avec le même squelette, les images peuvent dériver (teintes, contraste). Correction : Toujours valider une image et l’utiliser en style ref pour le lot.

Variables qui « tirent » vers un autre style.

Ex. : « neon, cyberpunk » dans une variable alors que le squelette dit « muted, warm ». Correction : Garder les variables neutres par rapport au style (sujet, action) ; tout le look vient du squelette et de la ref.

Oublier le ratio.

Générer 20 images sans préciser --ar : mélange de 1:1 et 4:3 selon l’outil. Correction : Fixer le même --ar pour toute la campagne (ou un ar par format si tu déclines volontairement). Ratio et cohérence.

| Problème | Piste de solution |

|---|---|

| Série incohérente | Squelette identique partout ; style reference (--sref) à partir d’une image validée. |

| Une image « dérive » | Vérifier que le prompt contient bien le squelette complet ; régénérer avec même seed/ref. |

| Trop long à écrire à la main | Tableur (variable par ligne) + concaténation Squelette + Variable ; ou script. |

| Client veut un changement de style en cours | Mettre à jour le squelette et la ref ; régénérer le lot concerné. |

Le batch réussi, c’est une décision une fois (squelette + ref), puis des variables. Pas 20 décisions différentes.

Outils et automatisation

Tableur (Excel, Google Sheets).

Colonnes : Variable 1, Variable 2, Prompt final (formule = Variable1 & " " & Squelette). Copier les prompts dans l’outil de génération (Midjourney, API, etc.).

Scripts et API.

Si tu utilises une API (Midjourney, Flux, Stable Diffusion), un script peut lire une liste de variables, concaténer avec le squelette, et lancer les jobs. Utile pour 50+ visuels.

Style reference.

Sur Midjourney : upload de l’image validée, puis --sref [url]. Sur Flux / SD : selon l’interface (image reference, style transfer). Pour Midjourney V8 et nouveautés, vérifier la doc pour --sref et le batch.

Ressource vidéo : Pour voir un workflow batch (squelette + variables + style ref), cherchez sur YouTube « Midjourney batch consistent style » ou « AI image generation campaign workflow ».

Foire aux questions

Combien d’images avec la même style ref ?

En pratique, 10 à 50 images restent cohérentes si le squelette est strict. Au-delà, vérifier régulièrement que le style ne dérive pas ; renouveler la ref si besoin (une nouvelle image validée).

Faut-il la même seed pour tout le lot ?

Non. La style reference et le squelette assurent la cohérence. Des seeds différentes donnent des variations de contenu (sujet, pose) tout en gardant le look.

Peut-on avoir plusieurs squelettes pour une même campagne ?

Oui. Ex. : squelette A pour les « portraits », squelette B pour les « packshots ». Chaque sous-série a son squelette et sa ref. Ne pas mélanger A et B dans la même image.

Variable vide ou optionnelle ?

Si une image n’a pas de « sujet » variable (ex. paysage pur), le squelette peut contenir le sujet (« Wide shot, mountain at golden hour ») et la variable peut être vide ou « same ». L’important est de ne pas introduire de termes contradictoires.

Batch sur Stable Diffusion sans --sref ?

Oui. La cohérence vient alors uniquement du squelette (même prompt, même modèle, mêmes paramètres). Une ref d’image (img2img ou ControlNet style) améliore encore. Voir analyse du poids des références.

Comment livrer au client (formats, naming) ?

Exporter aux ratios demandés (16:9, 1:1, etc.), nommer par convention (Campagne_01_VariableA, etc.) et fournir un récap du style guide (squelette + ref) pour les évolutions futures. Pour la commercialisation des visuels IA, garder une trace des prompts et des paramètres pour les droits et les réutilisations.

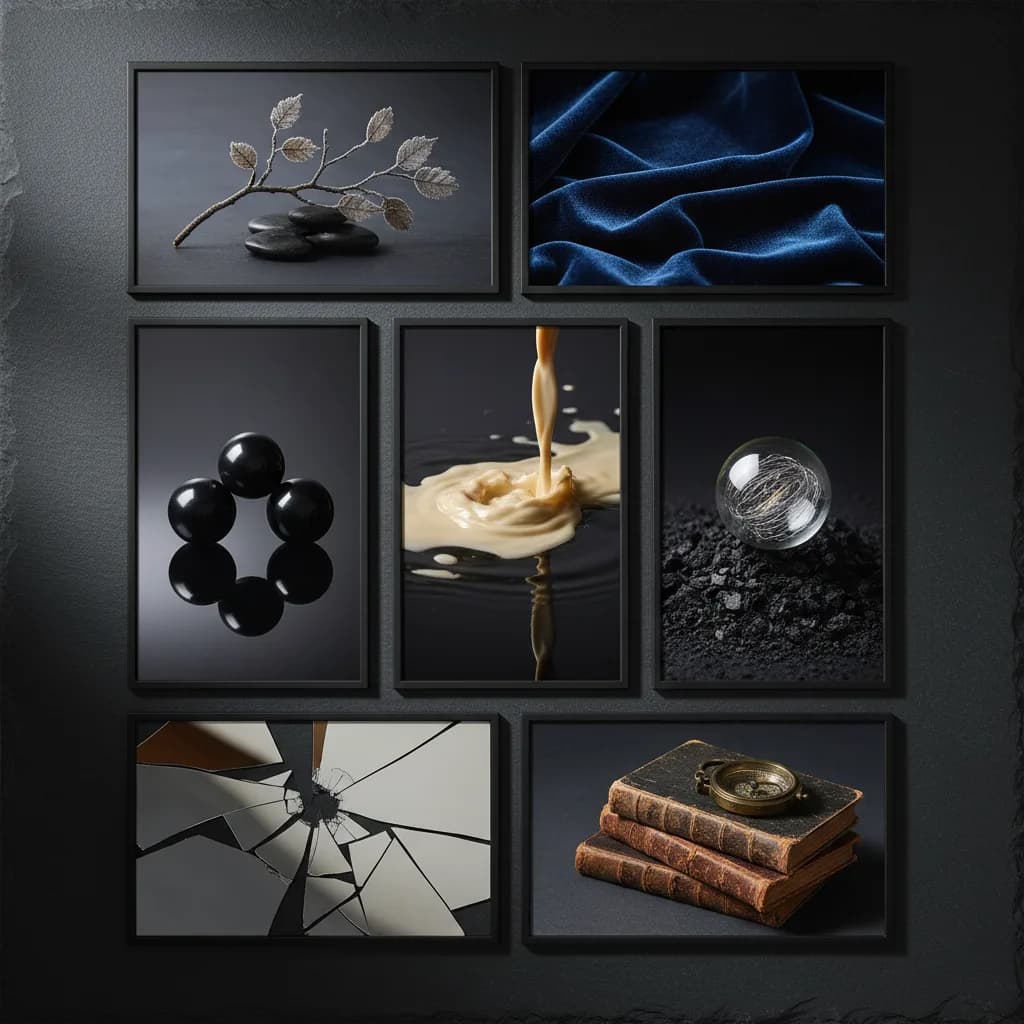

Prompt: Cinematic stills, cinema photography, six frames same lighting and palette different subjects, dark background, no person --ar 4:3

Ressource externe recommandee

Prompt Engineering Guide, bonnes pratiques et exemples actionnablesVotre avis

Chargement…

Sur le même thème sur ce site

Ces guides prolongent l’article sans répéter le même angle. Ils renforcent le maillage interne et aident à explorer le sujet en profondeur.

Voir tous les articles « Images IA »

- Meilleures IA pour générer des images

- Prompts images photoréalistes, qualité studio

- Premiers pas avec Midjourney

- Guide complet pour débuter en IA

Articles proches sur le blog

Suggestions basées sur la catégorie, les mots du titre et le sujet, pour prolonger la lecture sans dupliquer les piliers ci-dessus.

- Le prompting paramétrique , Gérer le chaos mathématique et la stylisation

- Vendre ses images IA en 2026 , Les banques d'images acceptant le synthétique

- Le Top 10 des générateurs d'images gratuits sans inscription en 2026

- Images trop petites pour l'impression : Le guide définitif de l'Upscaling

Sources et cadre officiel (lectures externes)

Renseignements généraux, droit et bonnes pratiques publiés par des institutions. À consulter selon votre situation et votre juridiction.

Frank Houbre - expert IA vidéo et Image

Frank Houbre est un expert en IA vidéo et image, artiste IA et filmmaker récompensé aux Seoul International AI Film Festival et aux Mondial Chroma Awards. Avec plus de 10 ans d'expérience en entrepreneuriat digital, il crée des courts-métrages et animés entièrement générés par IA (Midjourney, Kling, Adobe Firefly). Co-Fondateur de Screenweaver et de la communauté #AIStudios, il partage des tutoriels gratuits et avis d'outils sur Business Dynamite pour aider les créateurs à automatiser leur production.

Continuer la lecture

Le prompting paramétrique , Gérer le chaos mathématique et la stylisation

Seed, chaos, stylize, poids : comment les paramètres numériques influencent la variabilité et le style des sorties IA, et comment les piloter.

Vendre ses images IA en 2026 , Les banques d'images acceptant le synthétique

Où et comment vendre des images générées par IA : plateformes, conditions, droits et bonnes pratiques pour les créateurs.

Le Top 10 des générateurs d'images gratuits sans inscription en 2026

Générez des images IA immédiatement, sans compte, sans carte bancaire. Notre sélection des 10 meilleurs outils gratuits accessibles en quelques clics.

Images trop petites pour l'impression : Le guide définitif de l'Upscaling

Vos images IA sont trop petites pour l'impression ? Guide complet de l'upscaling : outils, techniques, et paramètres pour agrandir sans perdre en qualité.

Les erreurs à éviter pour ne pas se faire bannir des banques d'images

Vendre ou publier des images sur les banques d'images (Shutterstock, Adobe Stock, etc.) sans se faire rejeter ou bannir : règles, contenu IA, qualité et droits.

IA visuelle vs Banques d'images traditionnelles : Faut-il résilier ses abonnements ?

Comparatif honnête : quand garder un abo banque d'images (Shutterstock, Adobe Stock), quand passer à l'IA, et quelle stratégie hybride adopter en 2026.