Mes personnages changent de visage : Techniques de consistance (Seed, LoRA)

Comment garder le même personnage d'une image à l'autre ? Guide complet sur les seeds, les LoRA, et les techniques de consistance pour vos projets IA.

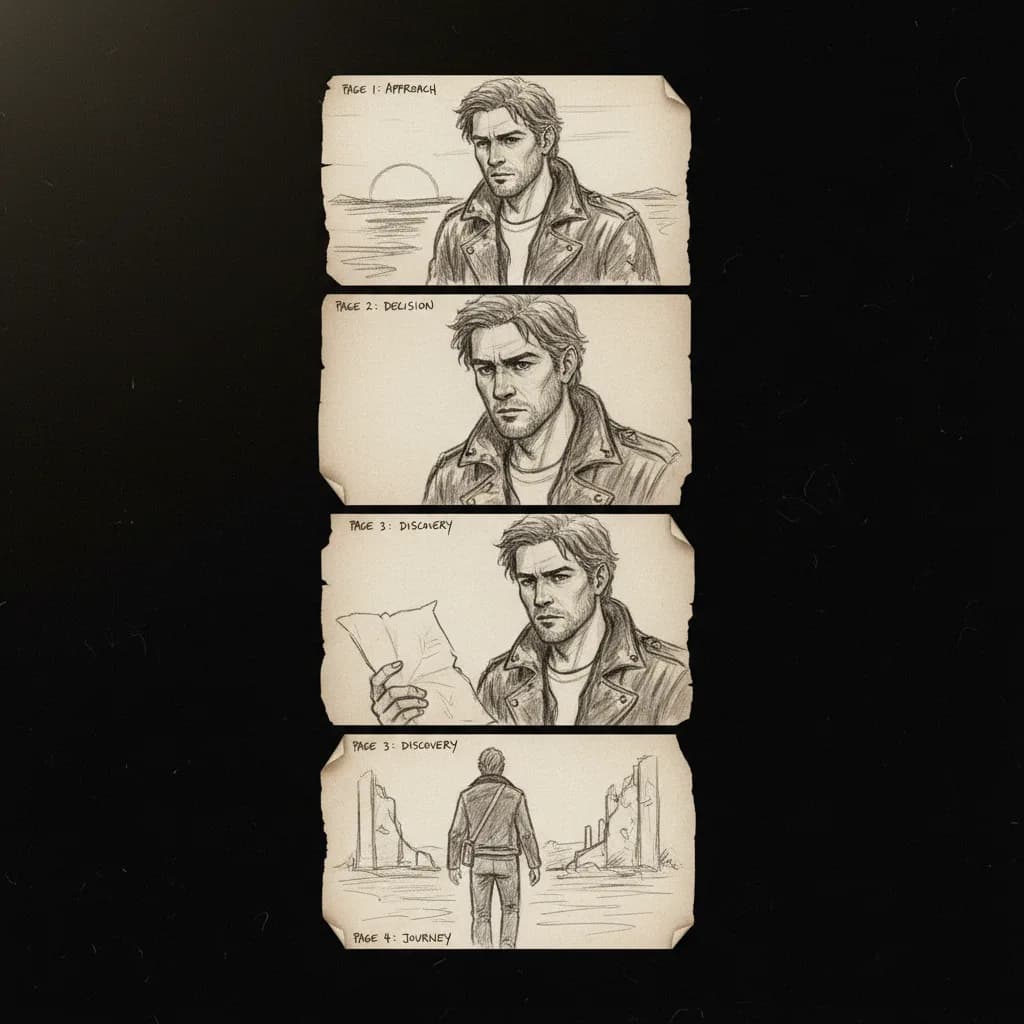

Vous créez un storyboard. Une série d'illustrations pour un livre. Un projet de court-métrage. Vous avez besoin que votre personnage principal reste le même sur 20, 50, peut-être 100 images différentes.

Mais à chaque génération, le visage change. Les cheveux passent du brun au noir. Les yeux changent de couleur. L'âge varie. C'est frustrant au point de rendre certains projets impossibles.

Ce problème de consistance est l'un des défis majeurs de l'IA générative. Mais il existe des solutions. Ce guide vous présente toutes les techniques disponibles, de la plus simple à la plus avancée.

Pour aller plus loin avec une demonstration pratique, cette video est directement liee au sujet.

Générer des Images IA : Le Guide COMPLET pour Débuter

Pourquoi l'IA génère des personnages différents

Comprenons d'abord le problème. Quand vous tapez "a woman with brown hair", l'IA ne pense pas à UNE femme spécifique. Elle génère UNE PARMI DES MILLIONS de femmes possibles correspondant à cette description.

À chaque génération, le point de départ aléatoire (le "seed") est différent. Le résultat est donc différent, même avec exactement le même prompt.

C'est comme demander à mille artistes de dessiner "une femme brune". Vous obtiendrez mille femmes différentes.

La consistance n'est pas un défaut qu'on corrige, c'est une fonctionnalité qu'on doit explicitement activer ou construire.

Technique 1 : Le Seed fixe (la base)

Ce que c'est

Le seed est un nombre qui initialise le générateur aléatoire. Avec le même seed et exactement les mêmes paramètres, vous obtenez exactement la même image.

Comment l'utiliser

- Générez une image qui vous plaît

- Notez le seed (affiché dans l'interface ou les métadonnées)

- Pour les générations suivantes, entrez ce seed manuellement

Dans Midjourney : Ajoutez --seed [nombre] à la fin de votre prompt.

Dans Stable Diffusion : Remplacez -1 par le numéro de seed dans l'interface.

Les limites

Le seed fixe ne marche que si tout le reste est identique. Si vous changez le prompt, la résolution, ou le modèle, le personnage changera malgré le seed fixe.

Utilité : Générer des variations mineures (expressions, éclairages) en gardant le même personnage de base.

Technique 2 : L'image de référence (Image-to-Image)

Ce que c'est

Au lieu de partir de zéro, vous partez d'une image existante de votre personnage. L'IA s'en inspire pour générer la nouvelle image.

Comment l'utiliser

Dans Midjourney :

- Uploadez votre image de référence

- Utilisez-la avec votre prompt :

/imagine [URL de l'image] prompt

Dans Stable Diffusion (img2img) :

- Chargez votre image dans l'onglet img2img

- Rédigez le nouveau prompt

- Ajustez le denoising strength (plus bas = plus fidèle à l'original)

Les limites

L'image de référence influence le résultat mais ne le garantit pas. Le personnage peut dériver progressivement au fil des générations. Et changer d'angle de vue reste problématique.

Technique 3 : Les LoRA de personnage (la solution avancée)

Ce que c'est

Un LoRA (Low-Rank Adaptation) est un mini-modèle qui encode un concept spécifique, comme un style visuel ou... un visage particulier. Vous pouvez créer un LoRA de votre personnage, puis l'utiliser dans toutes vos générations.

Comment ça fonctionne

- Vous rassemblez 10-30 images de votre personnage (générées ou réelles)

- Vous entraînez un LoRA sur ces images (processus automatisé)

- Vous obtenez un fichier LoRA (~50-200 Mo)

- Vous l'activez dans Stable Diffusion

- Toutes vos générations incluent ce personnage

Les avantages

- Consistance très élevée (visage, caractéristiques)

- Fonctionne avec différents angles, poses, éclairages

- Le personnage peut être dans n'importe quelle scène

Les limites

- Nécessite un entraînement (quelques heures sur un bon GPU)

- Ne fonctionne qu'avec Stable Diffusion (pas Midjourney)

- Demande des images de base de qualité

Comment entraîner un LoRA de personnage

Option 1 : Kohya_ss (gratuit, local)

- Installez Kohya_ss (GUI pour l'entraînement)

- Préparez 15-30 images de votre personnage

- Créez des fichiers de description pour chaque image

- Lancez l'entraînement (2-4 heures sur RTX 3060)

Option 2 : Services en ligne (payant, simple)

Des services comme CivitAI proposent l'entraînement de LoRA en ligne. Vous uploadez vos images, vous payez quelques dollars, vous récupérez le LoRA.

Option 3 : GPU cloud

Louez un GPU puissant pour quelques heures, entraînez votre LoRA rapidement.

Technique 4 : Runway Gen-4 et la consistance native

Ce que c'est

Runway Gen-4 a introduit des fonctionnalités de consistance de personnage directement dans leur interface. Vous uploadez une référence, et Runway maintient ce personnage à travers les plans vidéo.

Comment l'utiliser

- Dans Runway, uploadez une image de votre personnage

- Utilisez-la comme "character reference"

- Générez vos vidéos, le personnage reste cohérent

Les avantages

- Fonctionne pour la vidéo (pas juste l'image)

- Pas besoin d'entraînement

- Interface simple

Les limites

- Payant (abonnement Runway)

- Moins de contrôle qu'un LoRA

- Limité à l'écosystème Runway

Technique 5 : ControlNet pour les poses

Ce que c'est

ControlNet permet de guider la génération avec des références de structure : squelette de pose, contours, profondeur. Combiné avec un seed fixe ou un LoRA, il assure que le personnage ait la bonne pose.

Comment l'utiliser

- Installez l'extension ControlNet dans Stable Diffusion

- Téléchargez les modèles ControlNet (OpenPose, Canny, etc.)

- Pour chaque génération, fournissez une référence de pose

- L'IA respecte la pose tout en utilisant votre LoRA/seed

Avantage clé

Vous pouvez avoir le même personnage dans des poses totalement différentes, ce qui est difficile avec juste un seed fixe.

Tableau comparatif des techniques

| Technique | Complexité | Consistance | Flexibilité | Coût |

|---|---|---|---|---|

| Seed fixe | ★☆☆☆☆ | ★★☆☆☆ | ★☆☆☆☆ | Gratuit |

| Image référence | ★★☆☆☆ | ★★★☆☆ | ★★★☆☆ | Gratuit |

| LoRA personnage | ★★★★☆ | ★★★★★ | ★★★★★ | GPU time |

| Runway native | ★★☆☆☆ | ★★★★☆ | ★★★☆☆ | Abonnement |

| ControlNet + LoRA | ★★★★★ | ★★★★★ | ★★★★★ | GPU time |

Workflow recommandé pour un projet avec personnage récurrent

Phase 1 : Définir le personnage

- Générez 30-50 images exploratoires

- Sélectionnez les 15-20 meilleures qui représentent votre personnage idéal

- Variez les angles, expressions, éclairages dans votre sélection

Phase 2 : Créer le LoRA

- Préparez vos images (recadrez sur le visage/buste, résolution uniforme)

- Créez des descriptions (captions) pour chaque image

- Entraînez le LoRA (2-4 heures)

- Testez avec différents prompts

Phase 3 : Production

- Activez votre LoRA dans chaque génération

- Utilisez ControlNet pour les poses spécifiques

- Gardez un seed de référence pour les expressions récurrentes

- Corrigez les imperfections avec l'inpainting si nécessaire

Ce que les débutants font mal

Erreur 1 : Trop compter sur le prompt seul

"Je vais décrire mon personnage très précisément, ça suffira." Non. Un prompt détaillé aide, mais ne garantit pas la consistance.

La correction : Utilisez les techniques structurelles (seed, LoRA, références) en plus du prompt.

Erreur 2 : LoRA avec trop peu d'images

Vous entraînez un LoRA avec 5 images. Le résultat est pauvre, le personnage ne tient pas.

La correction : Minimum 15 images, idéalement 20-30, avec de la variété (angles, expressions, éclairages).

Erreur 3 : Ignorer la qualité des images d'entraînement

Vos images de référence sont floues, mal cadrées, incohérentes. Le LoRA apprend ces défauts.

La correction : Images nettes, bien éclairées, centrées sur le personnage. La qualité du LoRA dépend de la qualité des données.

Erreur 4 : LoRA weight trop élevé

Vous mettez le LoRA à 1.0 (maximum). L'image devient bizarre, sur-influencée.

La correction : Commencez à 0.6-0.8, ajustez selon les résultats. Plus n'est pas toujours mieux.

Erreur 5 : Attendre la perfection

"Mon personnage n'est pas 100% identique sur toutes les images." Ça n'arrivera jamais. Même les humains ne sont pas identiques sur toutes les photos.

La correction : Visez la cohérence, pas l'identité parfaite. Si le personnage est reconnaissable, c'est suffisant.

Foire aux questions

Le LoRA fonctionne-t-il avec Midjourney ?

Non. Les LoRA sont spécifiques à Stable Diffusion. Pour Midjourney, utilisez des images de référence et le paramètre --sref (style reference) pour une certaine cohérence.

Combien de temps pour entraîner un LoRA ?

Sur une RTX 3060, comptez 2-4 heures pour un LoRA de personnage standard. Sur une RTX 4090 ou un GPU cloud A100, ça peut descendre sous l'heure.

Puis-je créer un LoRA d'une vraie personne ?

Techniquement oui. Éthiquement et légalement, c'est complexe. Créer un LoRA de vous-même est acceptable. Créer un LoRA d'une célébrité ou d'une personne sans son consentement pose des problèmes de droit à l'image et potentiellement de deepfake.

Le seed fonctionne-t-il entre différents modèles ?

Non. Chaque modèle Stable Diffusion interprète les seeds différemment. Un seed qui donne un résultat sur Realistic Vision donnera autre chose sur DreamShaper.

Comment partager mon personnage avec d'autres ?

Partagez votre fichier LoRA. N'importe qui avec Stable Diffusion pourra l'utiliser et générer votre personnage. Attention à la propriété intellectuelle si c'est un personnage commercial.

La consistance est-elle possible pour des animaux ou objets ?

Oui, les mêmes techniques (LoRA, références) fonctionnent pour des animaux, véhicules, objets, ou tout concept visuel récurrent.

Quel est le meilleur outil pour la consistance vidéo ?

Pour la vidéo, Runway Gen-4 offre actuellement la meilleure consistance native. Sinon, générez des images consistantes avec LoRA puis animez-les avec des outils comme Luma ou Pika.

Votre avis

Chargement…

Sur le même thème sur ce site

Ces guides prolongent l’article sans répéter le même angle. Ils renforcent le maillage interne et aident à explorer le sujet en profondeur.

- Meilleures IA pour générer des images

- Prompts images photoréalistes, qualité studio

- Premiers pas avec Midjourney

- Guide complet pour débuter en IA

Sources et cadre officiel (lectures externes)

Renseignements généraux, droit et bonnes pratiques publiés par des institutions. À consulter selon votre situation et votre juridiction.

Frank Houbre - expert IA vidéo et Image

Frank Houbre est un expert en IA vidéo et image, artiste IA et filmmaker récompensé aux Seoul International AI Film Festival et aux Mondial Chroma Awards. Avec plus de 10 ans d'expérience en entrepreneuriat digital, il crée des courts-métrages et animés entièrement générés par IA (Midjourney, Kling, Adobe Firefly). Co-Fondateur de Screenweaver et de la communauté #AIStudios, il partage des tutoriels gratuits et avis d'outils sur Business Dynamite pour aider les créateurs à automatiser leur production.

Continuer la lecture

Cohérence visuelle IA , La technique des LoRA pour stabiliser un visage

Garder le même visage d’un plan à l’autre avec des LoRA et des références : workflow Stable Diffusion, Civitai, et limites.

Générer des personnages de BD cohérents sous tous les angles

Méthode pour créer et maintenir des personnages de BD ou d'illustration cohérents sous tous les angles avec l'IA (turnaround, fiches modèle, prompts).

Comprendre le paramètre "Seed" : Le secret pour des résultats réguliers

Même prompt, résultat différent à chaque fois ? Le seed contrôle le hasard. Voici comment il marche, où le trouver, et comment l'utiliser pour reproduire ou varier vos images.

Mon personnage change de visage à chaque plan : comment stabiliser son identité ?

Garder le même visage d’un plan à l’autre en IA : référence image, LoRA, character ref, et bonnes pratiques pour stabiliser l’identité du personnage.

Seed, Style Reference et sref , Maîtriser l'esthétique sur Midjourney

Reproduire une ambiance ou une composition sur Midjourney avec --seed et --sref : quand les utiliser, comment, et limites.

Éviter le "style Midjourney" , Techniques pour des rendus authentiques

Le rendu « typique Midjourney » (lisse, surréaliste, répétitif) se repère à des kilomètres. Comment s’en écarter pour des images qui sonnent pro et humaines.