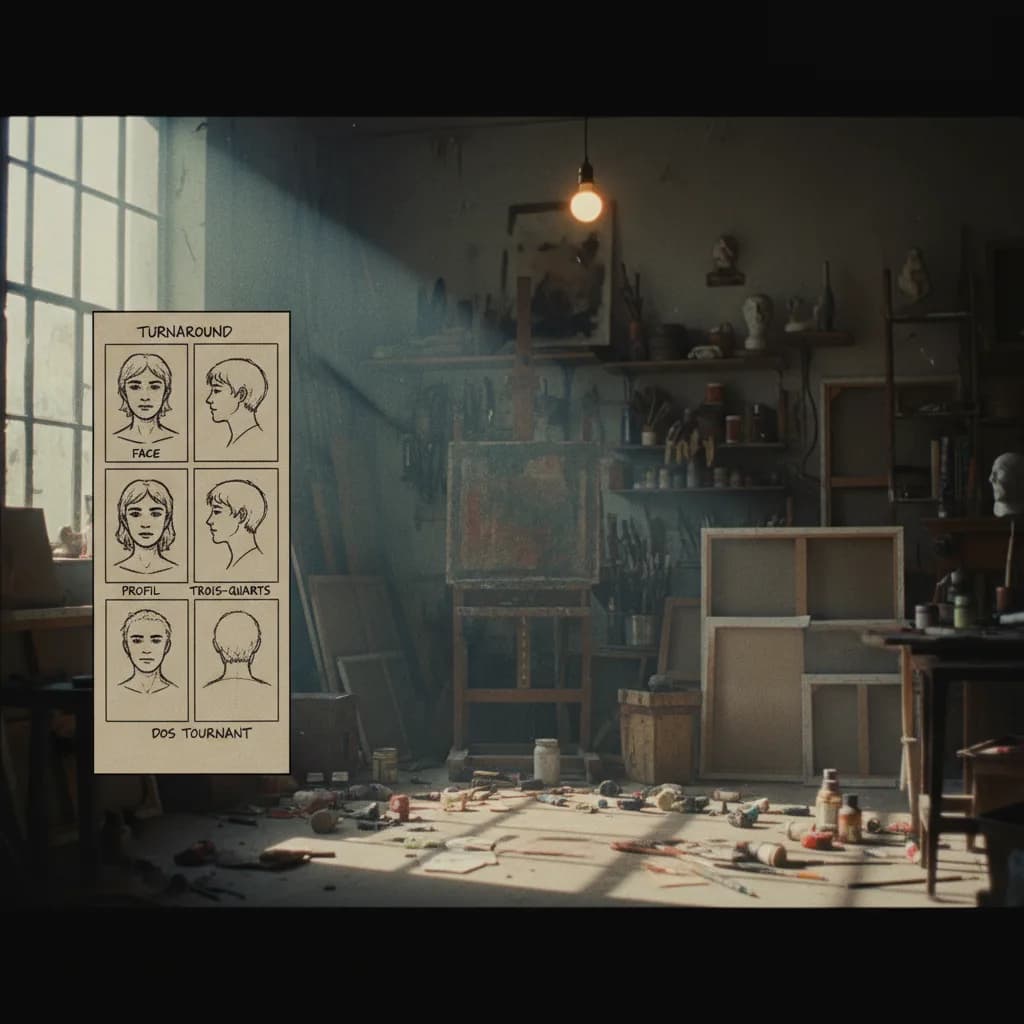

Générer des personnages de BD cohérents sous tous les angles

Méthode pour créer et maintenir des personnages de BD ou d'illustration cohérents sous tous les angles avec l'IA (turnaround, fiches modèle, prompts).

Tu génères un personnage de BD en IA, tu adores la première image. Le visage est parfait, l'attitude correspond exactement à ce que tu voulais. Puis tu essaies de le voir de profil. Le nez change. En contre-plongée, la mâchoire est différente. Assis, il a l'air d'un autre personnage.

C'est le problème central de la génération de personnages : l'IA ne comprend pas que tu veux le même individu sous différents angles. Pour elle, chaque prompt est une nouvelle demande indépendante.

L'IA ne te dispense pas du travail de turnaround (feuille de personnage multi-angles), elle le traduit différemment. Ce guide explique comment obtenir des personnages crédibles et réutilisables sous tous les angles : fiche ADN, style verrouillé, images de référence, techniques avancées, et erreurs classiques à éviter.

Pour aller plus loin avec une demonstration pratique, cette video est directement liee au sujet.

Générer des Images IA : Le Guide COMPLET pour Débuter

Pourquoi les personnages changent entre les images

Le fonctionnement des générateurs

Les modèles d'IA génèrent des images en interprétant ton prompt mot par mot, sans mémoire des images précédentes. Quand tu demandes "a young woman with curly hair", le modèle pioche dans des millions de références de femmes aux cheveux bouclés, choisissant aléatoirement parmi les possibilités.

Deux prompts identiques peuvent donner deux résultats différents à cause de cette part d'aléatoire. Et des prompts légèrement différents ("curly hair" vs "wavy hair") donnent des résultats très différents car ils activent des zones différentes du modèle.

Ce que le modèle ne comprend pas

Le modèle ne sait pas que :

- Le personnage du prompt précédent et celui du prompt actuel sont censés être la même personne

- Un nez spécifique doit rester identique vu de face ou de profil

- Les proportions du visage doivent être cohérentes sous tous les angles

Pour obtenir de la cohérence, tu dois compenser ces limites avec des techniques spécifiques.

Les trois piliers de la cohérence

Pilier 1 : Design interne solide

Un personnage bien conçu est plus facile à maintenir cohérent.

Pense en volumes : la forme de la tête (ronde, carrée, triangulaire), la masse de cheveux (volumineuse, plaquée), la silhouette globale (grande et fine, petite et trapue).

Traits structurants : nez distinctif, forme de mâchoire, sourcils marqués, lunettes caractéristiques. Ces éléments sont plus facilement identifiés par l'IA que les détails subtils.

Test de l'ombre chinoise : si ton personnage n'est pas reconnaissable en silhouette noire sur fond blanc, son design manque de force. Simplifie ou renforce les éléments distinctifs.

Évite les détails décoratifs seuls : "a woman with a flower in her hair" n'est pas un design, c'est un accessoire. Le personnage lui-même doit avoir des caractéristiques propres.

Pilier 2 : Style graphique verrouillé

Le style influence énormément l'apparence d'un personnage. Le même visage en ligne claire et en comics réaliste paraîtra très différent.

Choisis une famille de style : ligne claire, manga shonen, comics réaliste, cartoon, etc. Consulte le dictionnaire des 20 styles.

Garde les mêmes mots-clés : "clean line art, flat colors, minimal shading" pour chaque prompt du personnage. Ne varie jamais.

Ne teste pas de styles : une fois le personnage créé dans un style, reste-y pour tout le projet. Les tests de style se font avant de verrouiller le design.

Pilier 3 : Système de rappel

Tu as trois options pour rappeler le personnage au modèle :

Option A : Prompt pur : Tu copies-colles exactement la même description (fiche ADN) dans chaque prompt, en ne changeant que l'angle ou l'action.

Option B : Image de référence : Tu uploades une image maître du personnage et demandes au modèle de s'en inspirer.

Option C : Les deux combinés : prompt ADN + image de référence pour un contrôle maximum.

Les outils avec ControlNet, IP-Adapter ou équivalents permettent d'utiliser l'option B ou C efficacement.

Créer la fiche ADN du personnage

La fiche ADN est la description standardisée que tu utiliseras dans tous tes prompts.

Structure de la fiche

Identité : âge approximatif, genre Morphologie : taille, corpulence, proportions Visage : forme du visage, type de nez, yeux, bouche, menton Cheveux : couleur, texture, longueur, coiffure Accessoires fixes : lunettes, bijou permanent, cicatrice Tenue de base : vêtement principal, couleurs

Exemple de fiche ADN

"Young woman in her mid-twenties, slim athletic build, oval face with high cheekbones, straight nose with slight upturn, large almond-shaped dark brown eyes, full lips, pointed chin, short curly black hair with volume on top and shorter on sides, thin round metal glasses with gold frames, simple white t-shirt and dark blue jeans"

Règles de rédaction

Termes précis : "almond-shaped eyes" plutôt que "beautiful eyes". "Pointed chin" plutôt que "nice jaw".

Éléments vérifiables : chaque élément doit être visible et vérifiable dans l'image générée.

Formulation fixe : une fois écrite, ne modifie jamais la formulation. "Curly black hair" reste "curly black hair", jamais "wavy dark hair".

Longueur raisonnable : 50-80 mots maximum. Trop de détails noie les éléments importants.

Scénario : premier héros et turnaround 4 angles

Voici un workflow complet pour créer un personnage et son turnaround.

Étape 1 : Vue de face

Combine ta fiche ADN avec des instructions de cadrage et de style.

Prompt : "[Fiche ADN], front view only, standing straight facing camera, neutral expression, arms at sides, clean line art style, flat colors, minimal shading, solid white background, character design sheet style, full body visible, symmetrical pose"

Génère plusieurs versions, sélectionne la meilleure. Cette image devient ta référence maître.

Étape 2 : Vue trois-quarts

Prompt : "[Même fiche ADN], three quarter view, same character as before, same haircut, same glasses, same outfit, same proportions, standing relaxed, clean line art style, flat colors, minimal shading, solid white background"

Si ton outil accepte une image de référence, uploade la vue de face et ajoute : "matching the reference image".

Étape 3 : Vue de profil

Prompt : "[Même fiche ADN], side profile view facing right, same character, same nose shape, same chin, same hair volume, clean line art style, flat colors, solid white background"

Le profil est le plus difficile car il révèle la forme du nez et du menton sous un angle très différent.

Étape 4 : Vue de dos

Prompt : "[Même fiche ADN], back view, same character from behind, same hair, same outfit, same body proportions, standing straight, clean line art style, flat colors, solid white background"

Vérification de cohérence

Place les 4 vues côte à côte. Vérifie :

- La coiffure est-elle cohérente ?

- Les proportions du corps correspondent-elles ?

- Les vêtements sont-ils identiques ?

- Les accessoires (lunettes) sont-ils présents ?

Si des incohérences majeures apparaissent, régénère les vues problématiques ou corrige manuellement.

Techniques avancées

Utiliser IP-Adapter / Character Reference

Certains outils (Stable Diffusion avec IP-Adapter, Midjourney avec --cref) permettent d'uploader une image de référence que le modèle tentera de reproduire.

Workflow :

- Génère une vue de face parfaite

- Utilise cette image comme référence pour tous les autres angles

- Combine référence image + fiche ADN texte pour un contrôle maximum

Paramètres : la plupart des outils ont un curseur d'influence (0-100%). Commence à 70-80% pour maintenir le personnage tout en permettant le changement d'angle.

ControlNet pour les poses

ControlNet (dans Stable Diffusion) permet de contrôler la pose via un squelette ou une silhouette, indépendamment du personnage.

Workflow :

- Dessine ou génère une pose (ou utilise un modèle 3D)

- Extrais le squelette avec ControlNet OpenPose

- Génère le personnage avec ta fiche ADN + le squelette comme contrainte

Cela te donne un contrôle précis sur la pose tout en maintenant l'apparence du personnage.

Seed locking

Dans Stable Diffusion, le "seed" est le nombre aléatoire qui initialise la génération. Fixer le seed peut aider à maintenir une cohérence.

Attention : le seed seul ne garantit pas la cohérence si le prompt change. Il aide, mais ne remplace pas les autres techniques.

Générer le turnaround en une seule image

Certains modèles entraînés spécifiquement pour le character design peuvent générer un turnaround complet.

Prompt type : "Character turnaround sheet, front view, three quarter view, side profile, back view, all same character, [fiche ADN], white background, character design reference sheet"

Les résultats sont variables mais peuvent servir de base à affiner.

Gérer les expressions faciales

Une fois le design neutre verrouillé, tu peux générer des expressions.

Ordre de travail

- D'abord : expression neutre sous tous les angles

- Ensuite : expressions variées en vue de face

- Enfin : expressions sous d'autres angles si nécessaire

Prompts d'expression

Ajoute l'expression à ta fiche ADN standard :

Sourire léger : "[Fiche ADN], slight smile, warm expression, same facial structure"

Colère : "[Fiche ADN], angry expression, furrowed brow, same facial structure"

Tristesse : "[Fiche ADN], sad expression, downcast eyes, same facial structure"

Surprise : "[Fiche ADN], surprised expression, raised eyebrows, wide eyes, same facial structure"

Le rappel "same facial structure" aide à maintenir la cohérence.

Gérer les poses d'action

Décomposer les poses complexes

Pour une pose d'action (saut, combat, course), génère d'abord le personnage dans la pose, puis vérifie la cohérence avec tes références.

Prompt type : "[Fiche ADN], dynamic running pose, arms swinging, same character, clean line art, flat colors"

Utiliser des références de pose

Des sites comme Quick Poses ou Pose Maniacs fournissent des références de poses que tu peux décrire dans tes prompts ou utiliser avec ControlNet.

Tableau décisions

| Décision | Mauvais réflexe | Bon réflexe |

|---|---|---|

| Description | Changer les mots à chaque prompt | Fiche ADN identique, copier-coller exact |

| Style | Tester un style différent à chaque fois | Une famille de style fixe par projet |

| Angles | Tout demander en une image | Un angle par image, composer ensuite |

| Référence | S'en passer, se fier au texte seul | Une image maître par personnage |

| Expressions | Commencer par des expressions variées | Expression neutre d'abord, variations ensuite |

| Animation | Commencer par lip-sync ou vidéo | Verrouiller 4-6 angles statiques d'abord |

| Vérification | Valider chaque image isolément | Comparer côte à côte avec la référence |

Workflow complet pour un projet BD

Phase 1 : Design

- Écris la fiche ADN de chaque personnage principal

- Génère une vue de face de référence pour chacun

- Valide les designs, ajuste si nécessaire

- Génère le turnaround 4 angles pour chaque personnage

- Compile une planche de référence par personnage

Phase 2 : Production

- Pour chaque case de BD, identifie quel personnage et quel angle

- Utilise la fiche ADN + référence appropriée

- Ajoute les éléments de contexte (décor, action, expression)

- Génère et vérifie la cohérence avec les références

- Retouche manuellement si nécessaire

Phase 3 : Vérification finale

- Assemble toutes les images du projet

- Vérifie la cohérence globale de chaque personnage

- Identifie les incohérences et corrige

- Valide avec un regard neuf (ou un tiers)

Trench Warfare

Changer de description : "slim woman with curly hair" puis "young girl with wavy hair" = deux personnages pour le modèle. Les termes "slim/young" et "curly/wavy" activent des zones différentes. Copie-colle exactement la même fiche ADN.

Multiplier les styles : "ligne claire" un jour, "manga" le lendemain = personnage méconnaissable. Choisis un style principal et garde exactement les mêmes marqueurs stylistiques.

Trop dans un prompt : "front, profile and three quarter view" sur une seule image donne souvent des incohérences entre les vues. Un angle par image, puis assemble.

Négliger les détails récurrents : liste 3-5 détails distinctifs (lunettes, cicatrice, mèche de cheveux) et vérifie-les systématiquement à chaque génération. Un détail manquant = incohérence.

Perspective visage mal gérée : en contre-plongée ou plongée, les proportions du visage changent. Ajoute "realistic facial structure, correct perspective for this angle" ou accepte de corriger manuellement.

Ignorer les images de référence : même si ton outil ne supporte pas IP-Adapter nativement, garde toujours ta vue de face ouverte à côté pour comparer visuellement.

Validation image par image : chaque image générée doit être comparée aux références existantes, pas validée isolément.

Outils recommandés par niveau

Débutant

Midjourney : résultats propres, option --cref pour référence personnage DALL·E : facile d'accès, bonne cohérence de base

Intermédiaire

Leonardo AI : interface accessible, outils de cohérence intégrés Ideogram : bon pour les styles graphiques distinctifs

Avancé

Stable Diffusion + ControlNet + IP-Adapter : contrôle maximum sur pose et cohérence ComfyUI : workflows personnalisables pour des pipelines de production

Ressources et liens

Pour le style, dictionnaire visuel 20 styles. Pour l'animation, génération vidéo avancée. Pour le storyboard, script vers storyboard. Pour l'animation faciale, lip-sync IA. Character Design References, Pinterest pour l'inspiration.

Foire aux questions

Comment décrire mon personnage pour le retrouver sous tous les angles ?

Crée une fiche ADN stable avec 5-8 éléments clés, toujours formulés de la même façon ("short curly black hair", "thin round glasses"). Copie-colle exactement cette fiche dans chaque prompt, en ne changeant que l'angle, la pose ou l'expression. La cohérence vient de la répétition exacte.

Quel est le meilleur outil pour des personnages BD cohérents ?

DALL·E et Midjourney pour des premières images propres et accessibles. Stable Diffusion avec ControlNet et IP-Adapter pour un contrôle avancé sur poses et cohérence. La méthode (fiche ADN, références, vérification) compte plus que l'outil. Un bon workflow donne de bons résultats sur n'importe quel générateur.

Comment faire un turnaround complet sans savoir dessiner ?

Génère d'abord une vue de face parfaite, c'est ta référence maître. Utilise-la comme image de référence (IP-Adapter, --cref) et demande "three quarter view" puis "side profile" avec exactement la même description textuelle. Vérifie chaque vue contre la référence. IP-Adapter ou équivalent verrouille les traits du visage.

Comment varier les expressions sans perdre la ressemblance ?

Assure d'abord la cohérence totale en expression neutre sous plusieurs angles. Ensuite seulement, ajoute des expressions ("slight smile", "angry expression") en gardant "same facial structure, same haircut" dans le prompt. Les expressions subtiles maintiennent mieux la cohérence que les expressions extrêmes.

Mon personnage change à chaque génération, que faire ?

Combine plusieurs techniques : seed fixe (aide mais ne suffit pas), image de référence systématique, fiche ADN copiée-collée exactement. Vérifie chaque génération contre la référence avant de l'accepter. Si un élément récurrent manque (lunettes, cicatrice), régénère ou corrige manuellement.

Comment intégrer ces personnages en vidéo ou animation ?

Verrouille d'abord le design sur 4-6 angles et 3-4 expressions statiques. Ensuite seulement, utilise des outils d'animation ou de lip-sync. Génère des images clés (keyframes) pour les poses importantes et assemble au montage. Ne commence jamais l'animation avant que le design soit stable.

Combien de temps pour créer un personnage cohérent ?

Compte 1-2 heures pour un personnage principal complet (fiche ADN + turnaround 4 angles + 4-5 expressions). Les personnages secondaires peuvent être plus rapides (30-45 minutes pour face + trois-quarts). L'investissement initial est rentabilisé sur tout le projet.

Faut-il retoucher manuellement ?

Souvent, oui. L'IA donne une base solide mais certains détails nécessitent des corrections : position exacte des lunettes, forme du nez en profil, cohérence d'un accessoire. Prévois un temps de retouche de 10-20% sur chaque image.

Votre avis

Chargement…

Sur le même thème sur ce site

Ces guides prolongent l’article sans répéter le même angle. Ils renforcent le maillage interne et aident à explorer le sujet en profondeur.

- Meilleures IA pour générer des images

- Prompts images photoréalistes, qualité studio

- Premiers pas avec Midjourney

- Guide complet pour débuter en IA

Sources et cadre officiel (lectures externes)

Renseignements généraux, droit et bonnes pratiques publiés par des institutions. À consulter selon votre situation et votre juridiction.

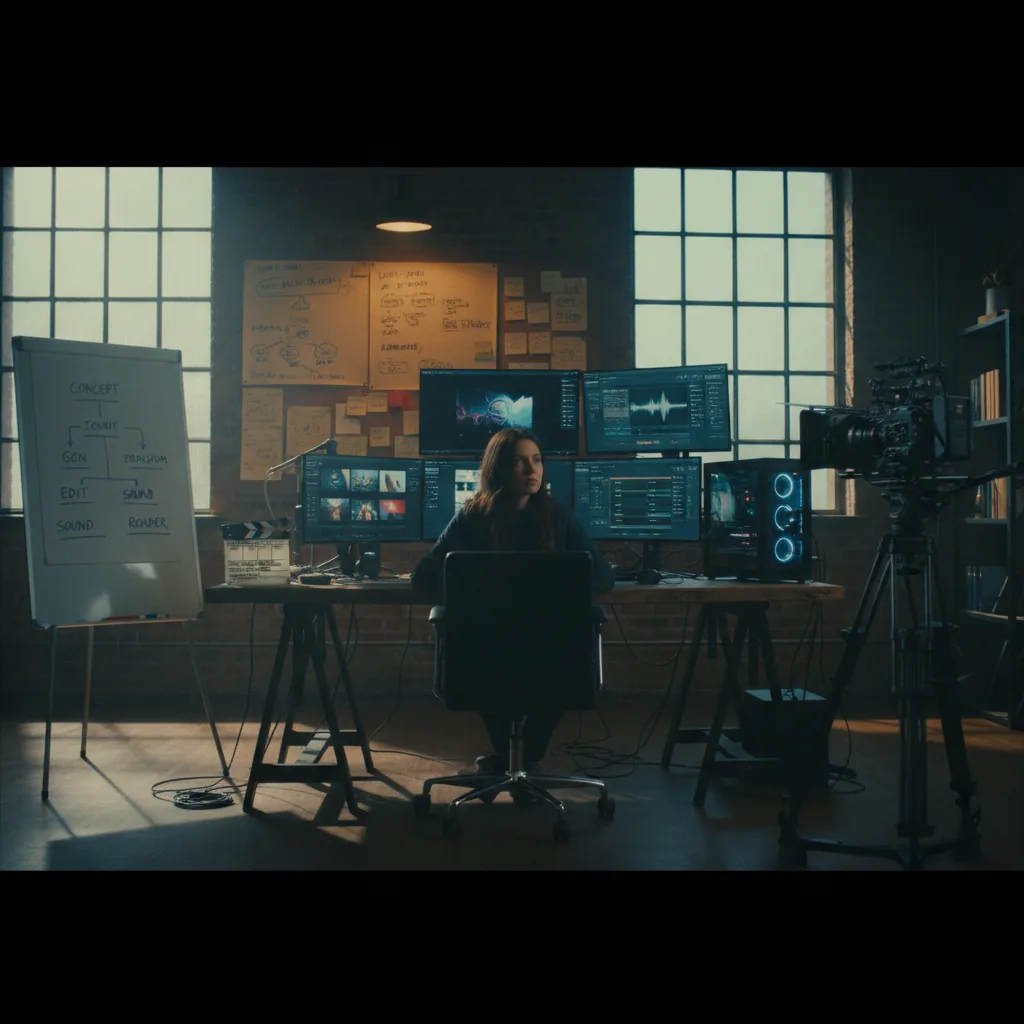

Frank Houbre - expert IA vidéo et Image

Frank Houbre est un expert en IA vidéo et image, artiste IA et filmmaker récompensé aux Seoul International AI Film Festival et aux Mondial Chroma Awards. Avec plus de 10 ans d'expérience en entrepreneuriat digital, il crée des courts-métrages et animés entièrement générés par IA (Midjourney, Kling, Adobe Firefly). Co-Fondateur de Screenweaver et de la communauté #AIStudios, il partage des tutoriels gratuits et avis d'outils sur Business Dynamite pour aider les créateurs à automatiser leur production.

Continuer la lecture

Générer des visuels publicitaires cohérents , Workflow de l'idée à l'export

De la brief à la livraison : comment enchaîner direction artistique, génération IA, cohérence et export pour une campagne pub.

Mes personnages changent de visage : Techniques de consistance (Seed, LoRA)

Comment garder le même personnage d'une image à l'autre ? Guide complet sur les seeds, les LoRA, et les techniques de consistance pour vos projets IA.

Générer des prompts Midjourney ultra-détaillés automatiquement via un LLM personnalisé

Transformer une idée vague en prompts Midjourney prêts à l'emploi avec ChatGPT, Claude ou un LLM fine-tuné. Système de prompts, paramètres et pièges à éviter.

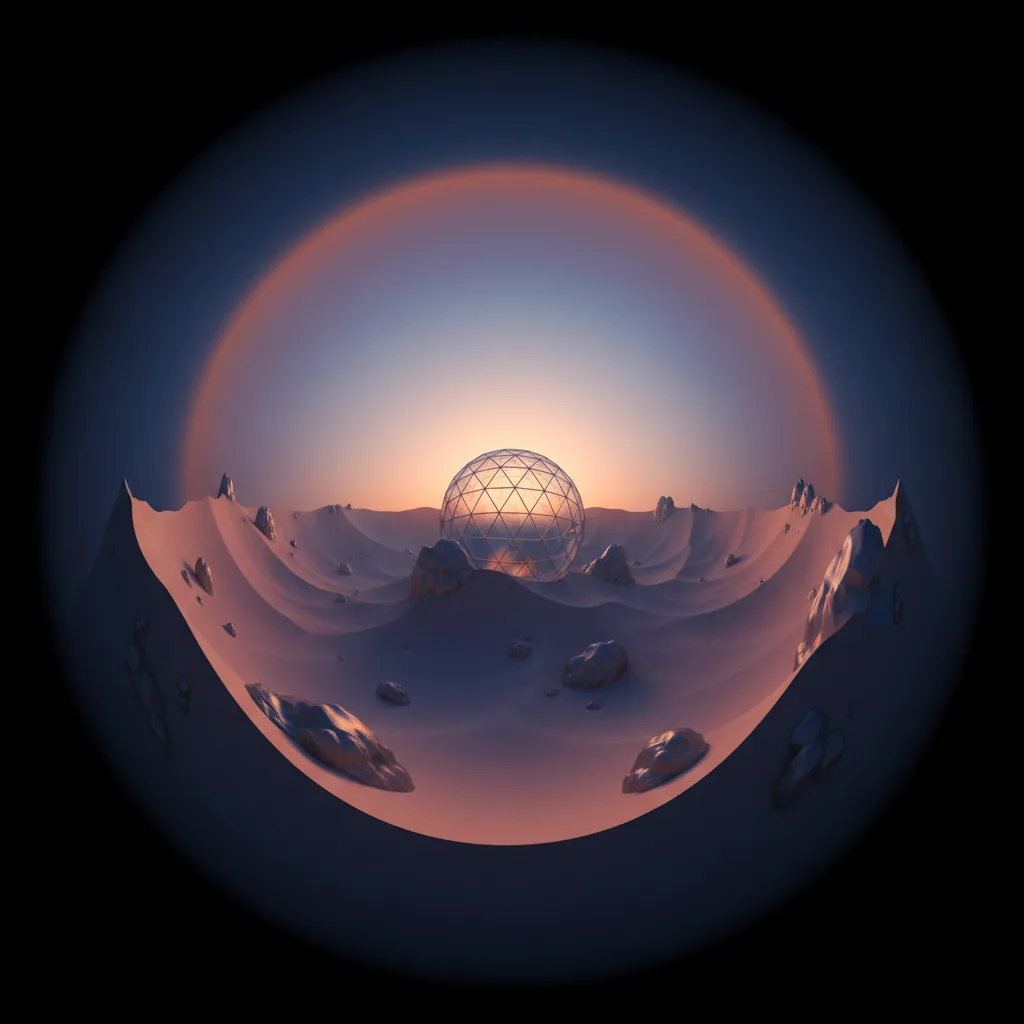

Comment générer des environnements HDRi à 360° par IA pour le rendu 3D

Créer ou adapter des HDRi (environnements à 360°) pour l’éclairage et les reflets en 3D : outils, workflows et limites en 2026.

Character Design IA , Conserver la régularité faciale sous tous les angles

Garder le même personnage sur plusieurs images : LoRA, référence image, et bonnes pratiques pour le design de personnage en IA.

YouTubeurs : Générer des miniatures (thumbnails) avec un fort taux de clic

Maîtriser la création de miniatures YouTube à fort CTR avec l'IA : composition, couleurs, texte et workflow pro sans look plastique.