Clonage Vocal et Avatars IA , Le Guide Complet HeyGen et Synthesia en Français

Tutoriel HeyGen et Synthesia en français : clonage vocal, avatars IA, vidéos multilingues et deepfake éthique pour la formation et la pub.

Tu dois enregistrer vingt modules de formation. La même voix. Le même ton. Et tu n’as pas une semaine de studio ni un comédien sous la main. Ou alors tu lances une chaîne YouTube sans montrer ton visage et tu veux que tes vidéos sonnent humaines, pas catalogue. Le clonage vocal et les avatars IA (HeyGen, Synthesia) existent précisément pour ça : produire des vidéos « talking head » en français et en multilingue sans tournage. Tu fournis un script, ou tu enregistres une fois ta voix pour la réutiliser, et la plateforme génère une vidéo d’avatar avec synchronisation labiale correcte. Idéal pour la formation, la com interne, les pubs et le doublage. Ce guide couvre les cas d’usage concrets, l’éthique (deepfake, consentement), les workflows pas à pas et ce que les débutants se trompent. Pour les limites du lip-sync sur les générateurs vidéo classiques, voir lip-sync et IA vidéo.

HeyGen et Synthesia : quoi de neuf en 2026 ?

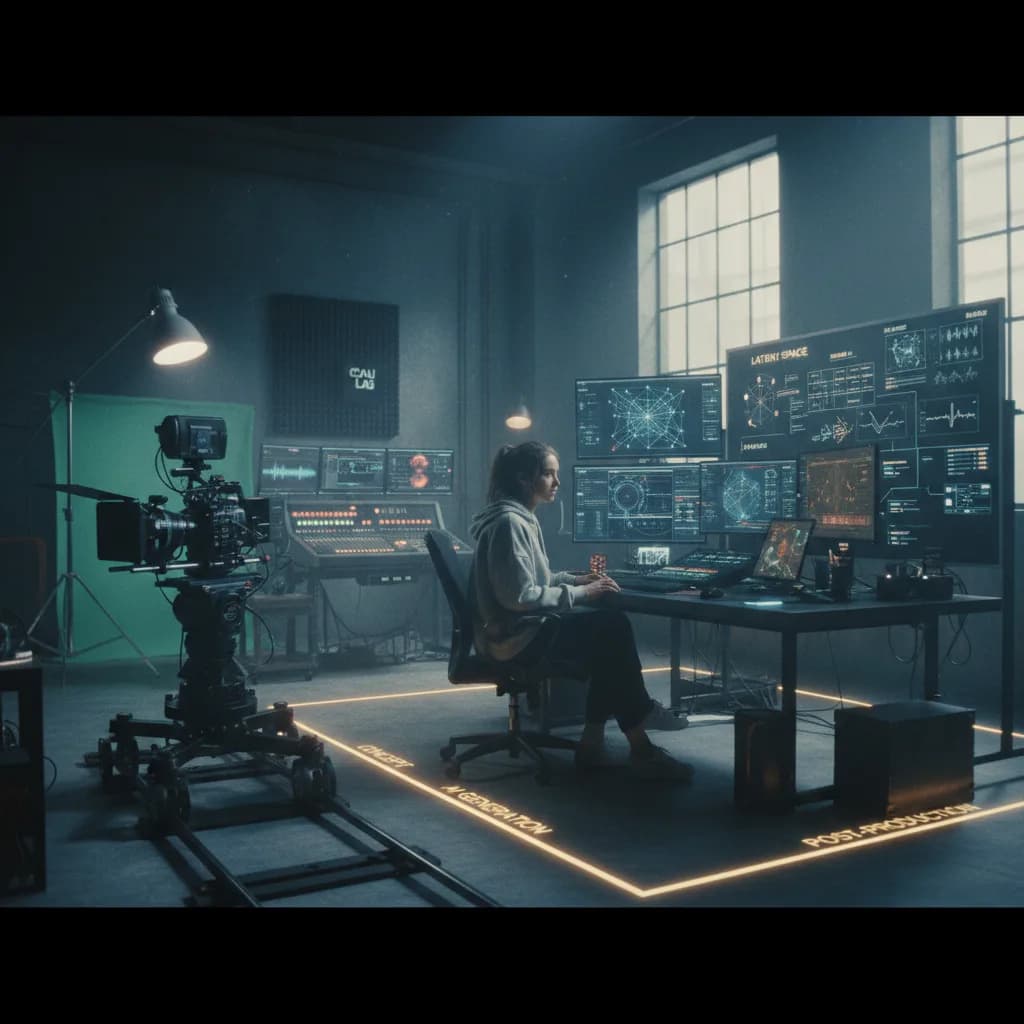

HeyGen et Synthesia ne sont pas de simples « générateurs de vidéos IA ». Ce sont des environnements complets : bibliothèque d’avatars (présentateurs virtuels), création de vidéos à partir d’un script, clonage vocal (enregistrer sa voix pour la réutiliser à l’infini), et sortie multilingue (traduction du script, voix dans la langue cible, lip-sync). Les interfaces évoluent chaque année ; les noms exacts des produits (Avatar 3.0, Personal Avatars, etc.) peuvent varier. Consultez les sites officiels pour les offres à jour. Ce qui ne change pas : la logique. Tu écris ou tu importes un script, tu choisis un avatar (ou tu en crées un à partir d’une photo), tu sélectionnes une voix (bibliothèque ou clone), et tu lances la génération. La vidéo sort avec les lèvres synchronisées. Pas de tournage. Pas de répétition. Mais il y a des pièges. On y revient.

Clonage vocal : principe, workflow et pièges

Comment ça marche

Tu enregistres un échantillon de ta voix (ou d’une voix pour laquelle tu as une autorisation écrite). En général, les plateformes demandent entre une et trois minutes de lecture à voix haute, dans un environnement calme, sans bruit de fond. Le modèle apprend à reproduire le timbre, le rythme et les inflexions. Ensuite, tu peux « faire dire » n’importe quel texte avec cette voix. Usages typiques : doublage, personnalisation de formations (ta voix sur tous les modules), cohérence de marque pour des annonces ou des tutoriels. L’éthique est non négociable : n’utilise que des voix pour lesquelles tu as le consentement explicite. La tienne, celle d’un client partenaire, ou celle d’un acteur sous contrat. Le deepfake non consenti est illégal et contraire à l’éthique. Les plateformes le rappellent dans leurs CGU.

Workflow pas à pas : enregistrer un clone vocal sur HeyGen

- Connexion et accès : Ouvre HeyGen, connecte-toi, et va dans la section Voice (ou Voices selon l’interface). Cherche l’option Clone your voice ou Custom Voice.

- Création du clone : Clique sur Create ou Add custom voice. Tu arrives sur une page qui te demande d’enregistrer un échantillon. Prépare un texte fourni par la plateforme (souvent une à deux minutes de lecture). Lis-le à voix naturelle, sans précipitation. Évite les bruits de bouche et les reprises. Un micro correct (même un bon casque) suffit ; pas besoin d’un studio.

- Enregistrement : Lance l’enregistrement. Fais une prise complète. Vérifie le niveau (pas de saturation, pas trop faible). Envoie l’échantillon. Le traitement peut prendre quelques minutes. Une fois le clone prêt, il apparaît dans ta bibliothèque de voix.

- Utilisation : Lors de la création d’une vidéo, sélectionne ton clone au lieu d’une voix catalogue. Saisis le script. Génère. La sortie utilisera ta voix (ou celle que tu as clonée).

Pro tip : Pour un clone stable, utilise un texte varié (questions, affirmations, chiffres). Évite les phrases trop courtes ou répétitives. Plus l’échantillon est propre et diversifié, moins tu auras d’artefacts ou de « robot » sur les phrases longues.

Avatars IA : choisir, créer, générer

Tu choisis un avatar dans la bibliothèque (présentateur, personnage, style pro ou décontracté) ou tu uploades une photo pour créer un avatar personnalisé. Sur Synthesia, les Personal Avatars permettent d’utiliser le visage d’un expert ou d’un dirigeant sans le faire tourner à chaque fois. Tu saisis le script ; l’outil génère la vidéo avec lip-sync synchronisé. Pas besoin de tournage. Usages : modules e-learning, annonces, pubs, communication interne. Pour produire des vidéos entreprise et e-learning rapidement, ces outils sont parmi les plus efficaces.

Workflow pas à pas : créer une vidéo avatar sur Synthesia

- Nouvelle vidéo : Dans Synthesia, clique sur Create video (ou équivalent). Tu arrives sur un canevas avec une scène par défaut.

- Choix de l’avatar : Dans le panneau de gauche, ouvre Avatars. Parcours la bibliothèque ou filtre par style (corporate, casual, etc.). Clique sur l’avatar pour l’ajouter à la scène. Si tu utilises un Personal Avatar (visage uploadé), sélectionne-le dans ta liste.

- Script : Clique sur la zone de texte sous l’avatar. Colle ton script. Vérifie la longueur (certains plans ont une limite de caractères ou de durée). Découpe en plusieurs scènes si besoin.

- Voix : Choisis la voix (catalogue ou clone). Ajuste la vitesse si l’outil le propose. Écoute un extrait avant de lancer toute la génération.

- Lancer la génération : Clique sur Generate (ou Create). La file d’attente s’affiche. Le rendu peut prendre de quelques minutes à une vingtaine selon la longueur et la charge serveur.

- Révision : Une fois la vidéo prête, visionne-la. Vérifie le lip-sync, les coupures, la prononciation. Si une phrase est mal rendue, modifie le script ou change de voix pour cette scène, puis régénère.

Multilingue : traduction, voix et lip-sync

HeyGen et Synthesia proposent la traduction du script vers une langue cible, puis la génération de la voix dans cette langue avec lip-sync. Utile pour des campagnes internationales ou des formations en plusieurs langues sans doubler manuellement. Le flux typique : script en français, clic sur « Traduire en anglais » (ou autre), révision du texte traduit, génération avec une voix anglaise (ou la même voix « locale » selon l’offre). Pour la traduction vidéo avec conservation de la voix d’origine (même personne, autre langue), voir traduire une vidéo avec la même voix et lip-sync.

Une ressource visuelle utile : la vidéo

SEEDANCE 2 SORT ENFIN : accès officiel, lien sécurisé, dangers des faux sites + mon avis

montre en conditions réelles comment HeyGen gère la traduction et le lip-sync multilingue. Tu y verras le flux script, langue cible, et rendu final, sans jargon.

Éthique et conformité

- Consentement : Ne clone pas une voix ou un visage sans autorisation explicite. Pour un dirigeant ou un client, fais signer une autorisation (usage, durée, supports). Pour ta propre voix, pas de souci.

- Transparence : Indique quand une vidéo est générée par IA. Les obligations légales et les bonnes pratiques évoluent en 2026 (ARCOM, plateformes). Mieux vaut être clair dès la publication.

- Usage interdit : Désinformation, usurpation d’identité, contenu illégal. Respecte les CGU des plateformes et la loi. En cas de doute, consulte un juriste ou la cadre légal et éthique des deepfakes en France.

HeyGen vs Synthesia : tableau de bord

| Critère | HeyGen | Synthesia |

|---|---|---|

| Avatars | Large bibliothèque, avatars 3.0 expressifs | Bibliothèque corporate, Personal Avatars (visage uploadé) |

| Clonage vocal | Oui, intégré | Oui, intégré |

| Multilingue | Traduction + voix + lip-sync | Traduction + voix + lip-sync |

| Cas d’usage fort | Affiliation, YouTube faceless, pub | Formation, com interne, sales enablement |

| Interface | Orientée rapidité, templates affiliation | Orientée scènes, slides, corporate |

| Prix | Crédits / abonnement, variable | Abonnement par utilisateur, paliers |

Aucun des deux ne « gagne » sur tout. HeyGen brille pour le volume créatif et l’affiliation ; Synthesia pour le cadre corporate et les Personal Avatars. Tu peux aussi combiner voix-off IA générée ailleurs avec un montage sur des visuels différents si tu veux séparer voix et avatar.

Scénarios réels

Scénario 1 : Formation interne, 15 modules. Thomas est responsable formation dans une PME. Il doit produire 15 vidéos de 5 à 10 minutes avec la même voix (celle du responsable métier, qui n’a pas le temps de tourner). Il enregistre une fois le responsable (script fourni par HeyGen pour le clone), crée un avatar à partir d’une photo du responsable, et génère les 15 vidéos avec le même script découpé par module. Résultat : cohérence totale, livré en quelques jours. Sans clone et sans avatar, il aurait dû soit faire tourner 15 fois le responsable, soit utiliser une voix catalogue moins crédible.

Scénario 2 : Chaîne YouTube faceless, 3 vidéos par semaine. Léa lance une chaîne d’affiliation. Elle ne veut pas montrer son visage. Elle clone sa propre voix pour garder une identité reconnaissable, choisit un avatar « présentateur » dans la bibliothèque HeyGen, et génère les vidéos à partir de scripts rédigés (ou aidés par un LLM). Elle exporte, ajoute des sous-titres avec sous-titres automatiques vidéo, et publie. Le goulot d’étranglement n’est plus le tournage mais la rédaction des scripts et le choix des produits.

Scénario 3 : Campagne B2B en 5 langues. Une marque B2B veut une même annonce produit en français, anglais, allemand, espagnol et italien. L’équipe rédige le script en français, le fait traduire (ou utilise la traduction intégrée), et génère 5 versions avec le même avatar et des voix natives dans chaque langue. Pas besoin d’embaucher 5 comédiens ni de gérer 5 tournages. Le coût reste l’abonnement et les crédits, pas la production classique.

Ce que les débutants se trompent (et comment corriger)

Erreur 1 : Un enregistrement de clone bâclé. Bruit de fond, souffle sur le micro, lecture trop rapide ou monotone. Le clone reproduit aussi les défauts. Correction : Enregistre dans une pièce calme, avec un micro correct (même un bon casque), et lis le texte à voix naturelle. Une seule prise propre vaut mieux que trois prises médiocres.

Erreur 2 : Script trop long sans découpage. Certaines plateformes limitent la durée par scène ou par prise. Un script de 10 minutes collé d’un bloc peut provoquer des erreurs de synchronisation ou des coupures bizarres. Correction : Découpe le script en blocs de 1 à 3 minutes. Crée une scène par bloc. Vérifie les limites affichées dans l’interface.

Erreur 3 : Avatar et ton incohérents. Un avatar « corporate » avec un script décontracté ou humoristique, ou l’inverse, donne un rendu bizarre. Correction : Choisis un avatar et une voix en adéquation avec le message (pro, amical, dynamique). Teste sur un court extrait avant de lancer la production en masse.

Erreur 4 : Pas de test de lip-sync. Certaines phrases (chiffres, noms propres, mots techniques) sont mal prononcées ou mal synchronisées. Correction : Génère d’abord un extrait de 30 secondes. Écoute et regarde. Corrige le script (réécris les phrases problématiques) ou change de voix pour ces passages. Puis lance la génération complète.

Erreur 5 : Oublier la transparence IA. Publier une vidéo 100 % avatar sans indiquer qu’elle est générée par IA peut poser des problèmes juridiques ou de confiance. Correction : Indique dans la description, en pied de vidéo ou à l’oral que la vidéo utilise une IA (avatar et/ou voix). Vérifie les recommandations ARCOM et des plateformes pour 2026.

| Problème | Piste de solution |

|---|---|

| Clone qui sonne robot | Réenregistrer l’échantillon, plus varié et plus naturel ; vérifier le niveau du micro |

| Lip-sync décalé sur une phrase | Réécrire la phrase plus simplement ; ou couper la scène en deux |

| Avatar qui « clignote » ou artefact | Changer d’avatar ou de résolution ; éviter les fonds trop chargés |

| Coût qui explose | Estimer le nombre de vidéos et de minutes ; choisir un abonnement adapté ; utiliser Relax / file d’attente si proposé |

![]()

Bonnes pratiques en résumé

- Script court et clair : Moins de répétitions, moins d’erreurs de prononciation. Évite les phrases trop longues ou les listes sans ponctuation.

- Ton adapté : Choisis une voix et un avatar en cohérence avec le message (pro, amical, dynamique). Teste sur un échantillon.

- Test avant volume : Vérifie le lip-sync et la prononciation sur un extrait avant de produire en masse. Ça te fait gagner des crédits et du temps.

![]()

Pour aller plus loin, le site officiel d’HeyGen propose des tutoriels et une documentation à jour : HeyGen – AI Video & Avatar (lien externe, non sponsorisé). Pour maîtriser les avatars et le lip-sync dans ton workflow, notre guide sur l’avatar virtuel pour vidéos YouTube complète ce tutoriel.

Foire aux questions

Quelle est la différence entre HeyGen et Synthesia pour le clonage vocal ?

Les deux proposent le clonage vocal intégré. La différence se situe surtout sur les cas d’usage : HeyGen est très orienté création de volume (affiliation, faceless), Synthesia sur le corporate et les Personal Avatars. La qualité du clone dépend surtout de la qualité de ton enregistrement, pas de la plateforme.

Puis-je utiliser la voix d’un client ou d’un partenaire ?

Oui, à condition d’avoir son consentement explicite (écrit de préférence), précisant l’usage, la durée et les supports. Sans consentement, c’est illégal et contraire aux CGU des plateformes.

Combien de temps faut-il pour créer un clone vocal ?

L’enregistrement : 5 à 15 minutes selon la longueur demandée. Le traitement côté plateforme : souvent 5 à 30 minutes. Une fois le clone prêt, tu peux générer des heures de voix sans retenregistrer.

Les avatars peuvent-ils bouger (gestes, full body) ?

Oui. HeyGen propose des avatars avec expressions et langage corporel (Avatar 3.0). Synthesia propose des Action Avatars (démonstration à l’écran). Les offres évoluent ; consulte les sites pour les options à jour.

Comment éviter que ma vidéo avatar soit refusée par une plateforme ?

Respecte les règles des plateformes (YouTube, Meta, etc.) : pas de contenu trompeur, indique quand c’est généré par IA si demandé. Utilise des scripts et des visuels conformes (pas de désinformation, pas d’usurpation). En cas de doute, vérifie les politiques de chaque plateforme.

Puis-je générer une vidéo en français et la même en anglais avec le même avatar ?

Oui. Utilise la fonction multilingue : traduis le script (ou laisse la plateforme le faire), puis génère une nouvelle vidéo avec la voix dans la langue cible. L’avatar reste le même ; seul le doublage change. Pour garder la même voix parlant une autre langue (traduction de ta voix), voir traduire une vidéo avec la même voix et lip-sync.

Faut-il un micro professionnel pour le clonage vocal ?

Non. Un micro correct (intégré à un bon casque ou micro USB) suffit. L’important est un environnement calme, pas de souffle sur le micro, et une lecture naturelle. Un studio pro améliore le rendu mais n’est pas obligatoire pour un usage formation ou interne.

Combien coûtent HeyGen et Synthesia ?

Les deux fonctionnent par abonnement et/ou crédits. Les tarifs varient selon le nombre d’utilisateurs, de minutes générées et d’avatars personnalisés. Consulte les pages tarifaires officielles pour des chiffres à jour ; prévois un budget mensuel adapté à ton volume de production.

Votre avis

Chargement…

Sur le même thème sur ce site

Ces guides prolongent l’article sans répéter le même angle. Ils renforcent le maillage interne et aident à explorer le sujet en profondeur.

Voir tous les articles « Vidéo IA »

- Meilleures IA pour créer des vidéos

- Tutoriels vidé IA avancés

- Workflow débutant, de l’idée à la vidéo

- Panorama des outils IA

Articles proches sur le blog

Suggestions basées sur la catégorie, les mots du titre et le sujet, pour prolonger la lecture sans dupliquer les piliers ci-dessus.

- Comment générer une voix off très réaliste en français sans micro ?

- Workflow IA complet pour une chaîne YouTube faceless : de l’idée à l’upload

- Pourquoi il est illégal de créer des avatars UGC IA pour donner un avis

- Logiciel montage video IA automatique, guide pratique 2026

Sources et cadre officiel (lectures externes)

Renseignements généraux, droit et bonnes pratiques publiés par des institutions. À consulter selon votre situation et votre juridiction.

Frank Houbre - expert IA vidéo et Image

Frank Houbre est un expert en IA vidéo et image, artiste IA et filmmaker récompensé aux Seoul International AI Film Festival et aux Mondial Chroma Awards. Avec plus de 10 ans d'expérience en entrepreneuriat digital, il crée des courts-métrages et animés entièrement générés par IA (Midjourney, Kling, Adobe Firefly). Co-Fondateur de Screenweaver et de la communauté #AIStudios, il partage des tutoriels gratuits et avis d'outils sur Business Dynamite pour aider les créateurs à automatiser leur production.

Continuer la lecture

Comment générer une voix off très réaliste en français sans micro ?

Synthèse vocale IA en français : outils, réglages et bonnes pratiques pour obtenir une voix off naturelle sans enregistrer au micro.

Workflow IA complet pour une chaîne YouTube faceless : de l’idée à l’upload

Chaîne sans visage ne veut pas dire chaîne sans direction. Voici un pipeline réaliste : idée, script, voix, visuels, montage, métadonnées, contrôle qualité, avec les pièges qui coûtent des strikes ou de la crédibilité.

Pourquoi il est illégal de créer des avatars UGC IA pour donner un avis

Créer un faux témoignage UGC avec un avatar IA semble simple, mais en France cela peut basculer vers la publicité trompeuse et des atteintes au droit à l'image. Guide pratique, juridique et technique pour débuter proprement.

Logiciel montage video IA automatique, guide pratique 2026

Comparatif des outils de montage video automatique avec IA, workflow reel de production, erreurs frequentes et methode simple pour livrer plus vite sans perdre en qualite.

Comment automatiser une partie de sa production YouTube avec l’IA

Automatiser ne veut pas dire « zéro humain ». On automatise ce qui est reproductible : transcriptions, premières coupes, checklists, exports. Voici où couper et où jamais.

Créer une chaîne YouTube business avec l’IA : méthode complète (réaliste)

Business ne veut pas dire fade. Voici positionnement, preuve sociale, calendrier, assets IA, et garde-fous légaux pour une chaîne qui vend sans ressembler à un robot.