Logiciels Upscaling Vidéo IA , Comment Passer vos Générations en Ultra HD 4K avec TensorPix

Passer vos vidéos générées par IA en Ultra HD 4K avec TensorPix : réglages, ratio d'agrandissement, coûts et bonnes pratiques pour un rendu pro.

Tu as généré une série de plans avec Runway ou Kling. Le rendu te plaît mais la résolution est en 720p ou 1080p. Ton client demande du 4K pour YouTube ou pour un écran événementiel. Un simple agrandissement donne du flou et du pixel. L’upscaling vidéo IA existe précisément pour ça : monter en résolution en reconstituant du détail de façon cohérente avec l’image source. TensorPix est l’un des outils dédiés : coût faible, interface simple, résultat souvent propre sur les textures. Ce guide décrit comment passer tes générations en 4K avec TensorPix, quels paramètres privilégier, ce que les débutants se trompent et comment intégrer l’étape dans ton workflow. Pour le workflow global, voir post-production vidéo IA et montage vidéo IA CapCut. L’upscale vient en général après le montage, une fois la structure et le rythme validés.

Pour aller plus loin avec une demonstration pratique, cette video est directement liee au sujet.

Kling 3.0 : il est (bientôt) là ! - Le meilleur générateur vidéo IA ?

Pourquoi upscaler les vidéos IA ?

Beaucoup de générateurs (Runway, Kling, Pika, Luma) sortent des clips en 720p ou 1080p. Pour une diffusion 4K (YouTube, Vimeo, livrable client, écran pro), un simple redimensionnement dégrade l’image. L’upscaling vidéo IA reconstitue du détail et de la netteté de façon cohérente avec la source : le modèle « devine » des textures plausibles au lieu d’étirer les pixels. TensorPix propose des profils et un ratio d’agrandissement (100 %, 200 %, etc.) pour viser le 4K à partir d’une source 1080p. Voila pourquoi c'est important, si tu livres en 1080p alors que le brief demande du 4K, tu passes pour amateur. Si tu livres du 4K upscalé proprement, le client et les plateformes voient une résolution pro. Pour des meilleurs générateurs vidéo IA en 2026, la sortie reste souvent en 720p ou 1080p ; l’upscale est donc une étape courante en post.

TensorPix : prise en main et workflow pas à pas

Import et paramètres

- Connexion : Va sur le site TensorPix (ou l’app selon l’offre), connecte-toi, et accède à la section vidéo / upscale.

- Upload : Uploade ta ou tes vidéo(s). Tu peux traiter plusieurs fichiers en batch selon ton abonnement. Vérifie les limites de durée et de taille (souvent indiquées sur la page).

- Ratio d’agrandissement : Choisis le ratio selon la résolution source et la cible. 1080p → 4K = 200 % (1920×1080 devient 3840×2160). 720p → 4K = tu montes à 300 % environ (1280×720 → 3840×2160). Un upscale à 200 % sur du 1080p donne du 4K (2160p). Ne dépasse pas le ratio nécessaire : upscaler du 1080p en 400 % pour « avoir encore plus » peut amplifier les artefacts sans gain réel sur la qualité perçue.

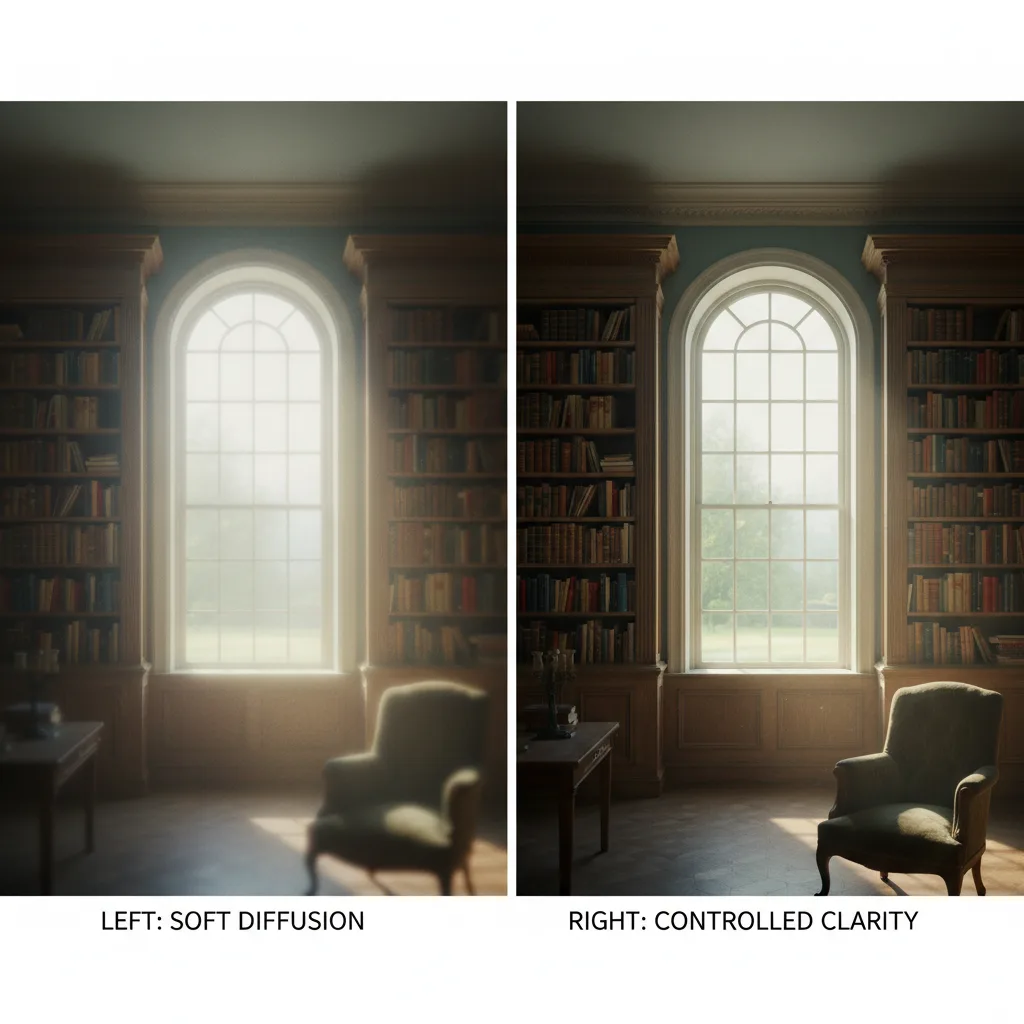

- Mode qualité / netteté : TensorPix propose souvent un mode « qualité » ou « netteté ». Teste sur un court extrait (10–20 secondes) avant de lancer tout le projet. Sur les visages et les tissus, un mode trop agressif peut créer des détails bizarres ; un mode trop doux laisse l’image un peu molle. Trouve le bon compromis sur un plan représentatif.

- Lancer le traitement : Valide et lance. Le temps de traitement dépend de la longueur et de la charge serveur. Tu reçois généralement un lien de téléchargement ou une notification quand c’est prêt.

- Télécharger et réintégrer : Télécharge la ou les vidéos upscalées. Réimporte-les dans ton logiciel de montage (CapCut, DaVinci, Premiere) pour finaliser ou remplacer les plans source.

Coûts (ordre de grandeur)

Exemple cité dans la doc : environ 0,17 crédit pour traiter cinq vidéos avec ratio 200 %. Les tarifs peuvent évoluer ; consulte le site TensorPix pour les crédits et abonnements 2026. En pratique, pour un court de 5 minutes découpé en 20 plans, tu peux estimer le coût en fonction du nombre de fichiers et de la durée totale. Comparé à un tournage 4K natif ou à une location de matériel, l’upscale IA reste très abordable. Pour un workflow vidéo IA gratuit ou low cost, TensorPix peut compléter après génération sans exploser le budget.

Pro tip : Avant de traiter tout un film, upscale un plan représentatif (un avec un visage, un avec une texture, un avec du mouvement). Valide le rendu. Si les bords ou les peaux deviennent bizarres, ajuste le mode ou le ratio avant de lancer le batch complet. Ça te fait économiser des crédits et du temps.

Tableau : résolution source, ratio et cible

| Résolution source | Ratio conseillé | Résolution cible |

|---|---|---|

| 720p (1280×720) | 200 % | 1440p |

| 720p | 300 % | 2160p (4K) |

| 1080p (1920×1080) | 200 % | 4K (3840×2160) |

| 1080p | 100 % | Inchangé (contrôle qualité uniquement) |

Scénarios réels

Scénario 1 : Court-métrage 5 min pour YouTube. Thomas a généré 40 plans en 1080p avec Runway et Kling. Il monte dans DaVinci, exporte une première version en 1080p pour validation. Une fois validée, il exporte plan par plan (ou une timeline complète) et passe chaque plan dans TensorPix en 200 %. Il récupère 40 plans en 4K, les réimporte, et exporte la version finale en 4K. Le client publie sur YouTube en 4K. Sans upscale, il aurait dû livrer en 1080p ou refaire toutes les générations sur un outil 4K (souvent plus cher et pas toujours disponible).

Scénario 2 : B-roll pour une pub 30 secondes. Sophie a 12 plans générés en 720p. Elle les upscale en 200 % pour obtenir du 1440p, suffisant pour un encodage YouTube et une diffusion web. Elle n’a pas besoin de 4K pour ce usage ; elle évite de pousser le ratio trop haut et garde un rendu propre. Pour des publicités vidéo haute conversion, la résolution compte mais le contenu et le rythme priment. Un 1440p propre vaut mieux qu’un 4K artefacté.

Scénario 3 : Client événementiel, écran géant. Un client demande une vidéo 4K pour un écran en événement. Les plans ont été générés en 1080p. Léa upscale tout en 200 % avec TensorPix, vérifie sur un écran 4K que le rendu tient la route (pas de flou, pas d’artefacts visibles à grande taille), puis livre. Pour résoudre le flickering et la cohérence temporelle avant upscale, elle a stabilisé les plans qui tremblaient ; l’upscale ne crée pas du détail à partir du flou, il améliore une source déjà stable.

Ce que les débutants se trompent (et comment corriger)

Erreur 1 : Upscaler une source déjà floue ou très compressée. L’IA ne crée pas du détail qui n’existe pas. Elle améliore et « devine » des détails plausibles. Si la source est floue ou dégradée, l’upscale peut amplifier les défauts ou produire des artefacts. Correction : Assure-toi que la source est la moins compressée possible (export en qualité maximale depuis ton générateur ou ton logiciel de montage). Évite d’upscaler du contenu déjà repassé par une compression YouTube ou un encodage bas débit.

Erreur 2 : Ne pas tester sur un extrait. Tu lances l’upscale sur 50 minutes de vidéo sans avoir vérifié le rendu. Au final, les visages sont bizarres ou le grain est trop fort. Correction : Upscale d’abord un plan de 10–20 secondes (idéalement avec un visage et une texture). Valide. Ajuste le mode ou le ratio si besoin. Puis lance le batch complet.

Erreur 3 : Mauvais format ou codec de sortie. Tu récupères des fichiers que ton logiciel de montage ne lit pas correctement, ou tu perds en qualité à l’export. Correction : Vérifie le format et le codec de sortie TensorPix (H.264, H.265, etc.) et la compatibilité avec ta chaîne (DaVinci, CapCut, Premiere). Exporte en 4K depuis ton logiciel avec un débit suffisant pour garder la qualité. Pour workflow post-production vidéo IA DaVinci Resolve, les réglages d’export 4K sont détaillés.

Erreur 4 : Croire que l’upscale corrige le flickering. Les artefacts temporels (flickering, instabilité) ne sont pas résolus par l’upscale. Ils peuvent même devenir plus visibles en 4K. Correction : Traite d’abord le flickering et la cohérence temporelle (stabilisation, plugins, ou régénération des plans problématiques). Puis upscale. Voir résoudre le flickering et la cohérence temporelle.

Erreur 5 : Ratio trop élevé pour la source. Tu passes du 720p en 400 % pour « avoir du 4K ». Le résultat peut être trop lisse ou artefacté. Correction : Reste sur un ratio cohérent : 200 % pour 1080p → 4K, 300 % pour 720p → 4K. Si la source est très bonne, 200 % sur 1080p suffit pour un rendu pro.

| Problème | Piste de solution |

|---|---|

| Rendu trop lisse / « plastique » | Réduire le mode netteté ou choisir un profil plus doux ; vérifier la source |

| Artefacts sur les visages | Tester un autre plan ou un mode moins agressif ; éviter d’upscaler du contenu déjà dégradé |

| Fichier trop lourd après upscale | Exporter en H.265 (HEVC) pour réduire la taille à qualité égale ; ajuster le débit en post |

| Incompatibilité avec le logiciel de montage | Vérifier le codec de sortie TensorPix ; convertir si besoin avec un outil (HandBrake, FFmpeg) |

Bonnes pratiques

- Conserver la netteté source : Un upscale à 200 % préserve mieux les détails si la source n’est pas déjà floue. Évite d’upscaler du contenu très compressé ou déjà dégradé.

- Tester un plan : Avant de traiter tout un film, upscale un plan représentatif (visage, texture, mouvement) pour valider le rendu.

- Exporter : Vérifie le format et le codec de sortie (H.264, H.265, etc.) pour la compatibilité avec ta chaîne de montage ou de diffusion. Pour un créer un mini-film de A à Z, l’upscale vient après le montage et avant l’export final.

Limites

L’upscaling ne crée pas du détail qui n’existe pas. Il améliore et « devine » des détails plausibles. Sur des zones déjà floues ou avec des artefacts (mains, visages déformés), le résultat peut rester imparfait. Sur des séquences avec flickering, l’upscale ne corrige pas le problème ; il peut le rendre plus visible. Pour les artefacts temporels, voir résoudre le flickering et la cohérence temporelle. TensorPix et les outils similaires sont des maillons de la chaîne, pas des solutions magiques. Une bonne source + un bon réglage = un 4K exploitable.

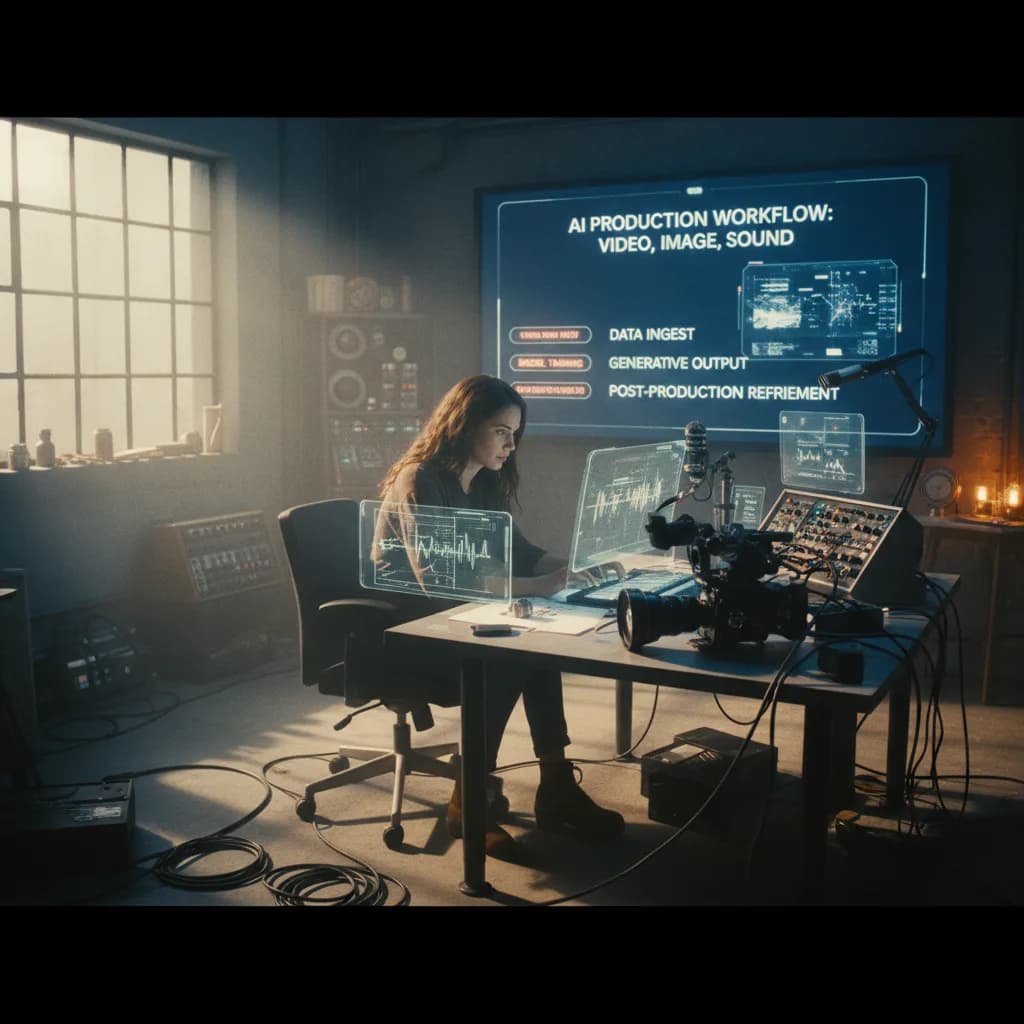

Intégration dans le workflow

- Générer tes séquences (Runway, Kling, Luma, etc.) en 720p ou 1080p.

- Monter une première version (CapCut, DaVinci, Premiere). Valide le rythme et le contenu.

- Exporter les plans ou la timeline en 1080p (ou résolution source), qualité maximale, pour servir de source à l’upscale.

- Passer par TensorPix pour l’upscaling vidéo IA vers 4K (ratio 200 % pour 1080p → 4K). Tester d’abord sur un extrait.

- Réimporter les plans 4K et finaliser le montage ou l’export (étalonnage, sous-titres, son). Export final en 4K.

Pour voir des démos d’upscaling vidéo et de post-production, les tutoriels « upscale vidéo IA » ou « TensorPix » sur YouTube montrent le flux en conditions réelles. Une ressource externe pour les normes et bonnes pratiques d’export vidéo : Specifications YouTube – Résolutions et formats (lien externe, non sponsorisé). Tu y trouveras les résolutions recommandées (dont 4K) et les codecs pour un rendu optimal.

Foire aux questions

TensorPix peut-il upscaler du 720p en 4K ?

Oui. Utilise un ratio d’agrandissement d’environ 300 % (720p → 2160p). Le rendu peut être un peu plus « interprété » qu’un 1080p → 4K (200 %), car la source contient moins d’informations. Teste sur un plan représentatif avant de traiter tout le projet.

Quelle est la différence entre upscale IA et redimensionnement classique ?

Le redimensionnement classique (bicubic, bilinear) étire les pixels : l’image devient plus grande mais pas plus détaillée, souvent plus floue. L’upscale IA utilise un modèle entraîné pour reconstituer du détail plausible (textures, bords) à partir de la source. Le résultat est en général plus net et plus exploitable pour une diffusion 4K.

Puis-je upscaler après avoir déjà exporté en 4K depuis mon logiciel de montage ?

Tu peux, mais ce n’est pas idéal. Si tu exportes une vidéo 1080p en « 4K » depuis ton logiciel, le logiciel fait un simple redimensionnement (étirement). Mieux vaut exporter la source en 1080p native, upscaler avec TensorPix (ou équivalent), puis réimporter les plans 4K et faire l’export final en 4K depuis le montage. Ainsi l’upscale IA travaille sur la vraie résolution source.

L’upscale amplifie-t-il le flickering ?

Il ne le corrige pas. Des plans qui flickent en 1080p flickeront encore en 4K après upscale, parfois plus visibles. Traite d’abord la cohérence temporelle et le flickering (stabilisation, plugins, ou régénération), puis upscale. Voir résoudre le flickering vidéo IA.

Combien coûte TensorPix pour un court de 10 minutes ?

Ça dépend du nombre de plans et de la durée totale traitée. Les tarifs sont en crédits ; consulte le site TensorPix pour les grilles à jour. En ordre de grandeur, traiter 20 à 30 plans (10 min découpée) reste souvent très abordable (quelques euros ou moins selon l’offre). Compare avec le coût d’une régénération 4K native si ton générateur le propose.

Quel format d’export choisir pour TensorPix ?

Choisis un format compatible avec ton logiciel de montage (H.264 ou H.265 courants). Pour garder la qualité, privilégie un débit élevé ou un profil « haute qualité » si proposé. Pour YouTube 4K, H.264 ou H.265 en 3840×2160 avec un débit adapté (voir les recommandations YouTube) suffit.

Puis-je utiliser un autre outil qu’TensorPix pour l’upscale 4K ?

Oui. Topaz Video AI, DaVinci Resolve (version Studio avec Super Scale), et d’autres solutions existent. TensorPix est cité ici pour son rapport coût / simplicité. Compare les essais gratuits et les tarifs selon ton volume. Pour Topaz Video AI et les artefacts sur vidéos générées, tu trouveras un point de vue sur une alternative.

L’upscale 4K est-il nécessaire pour YouTube ?

Non. YouTube accepte le 1080p et le 4K. La 4K améliore la qualité perçue sur les grands écrans et peut influencer légèrement la recommandation (qualité d’affichage). Pour un contenu pro ou un client exigeant, le 4K upscalé est un plus. Pour des tests ou du contenu rapide, le 1080p peut suffire. TensorPix et les outils similaires restent des alliés simples et peu coûteux pour franchir le cap 4K sans refaire toute ta génération.

Votre avis

Chargement…

Sur le même thème sur ce site

Ces guides prolongent l’article sans répéter le même angle. Ils renforcent le maillage interne et aident à explorer le sujet en profondeur.

Voir tous les articles « Vidéo IA »

- Meilleures IA pour créer des vidéos

- Tutoriels vidé IA avancés

- Workflow débutant, de l’idée à la vidéo

- Panorama des outils IA

Articles proches sur le blog

Suggestions basées sur la catégorie, les mots du titre et le sujet, pour prolonger la lecture sans dupliquer les piliers ci-dessus.

- Upscaling vidéo IA : passer de la génération 720p au rendu 4K professionnel

- La technique du Video-to-Video expliquée : Runway Gen-5 et au-delà

- Comment prolonger une vidéo existante au-delà de son cadre (Outpainting vidéo) ?

- Transformer une longue vidéo en plusieurs Shorts grâce à l’IA : méthode propre

Sources et cadre officiel (lectures externes)

Renseignements généraux, droit et bonnes pratiques publiés par des institutions. À consulter selon votre situation et votre juridiction.

Frank Houbre - expert IA vidéo et Image

Frank Houbre est un expert en IA vidéo et image, artiste IA et filmmaker récompensé aux Seoul International AI Film Festival et aux Mondial Chroma Awards. Avec plus de 10 ans d'expérience en entrepreneuriat digital, il crée des courts-métrages et animés entièrement générés par IA (Midjourney, Kling, Adobe Firefly). Co-Fondateur de Screenweaver et de la communauté #AIStudios, il partage des tutoriels gratuits et avis d'outils sur Business Dynamite pour aider les créateurs à automatiser leur production.

Continuer la lecture

Upscaling vidéo IA : passer de la génération 720p au rendu 4K professionnel

Agrandir et améliorer des vidéos IA en 720p pour un rendu 4K : outils, paramètres et pièges à éviter pour un résultat pro.

La technique du Video-to-Video expliquée : Runway Gen-5 et au-delà

Comprendre le Video-to-Video (V2V) de Runway Gen-5 et des autres moteurs : principe, workflow pas à pas et pièges à éviter pour un rendu pro.

Comment prolonger une vidéo existante au-delà de son cadre (Outpainting vidéo) ?

Étendre le cadre d’une vidéo avec l’IA : outpainting vidéo, outils et workflow pour agrandir le champ sans retourner.

Transformer une longue vidéo en plusieurs Shorts grâce à l’IA : méthode propre

Découper n’est pas résumer. L’IA trouve des moments forts, mais toi tu décides du sens, du cadre légal et du rythme vertical. Voici un workflow sans ruiner la vidéo longue.

Supprimer les artefacts visuels ("glitches" et scintillements) d'une vidéo IA

Flickering, morphing bizarre, pixels qui dansent : guide complet pour identifier et corriger les artefacts des vidéos générées par IA.

Ma vidéo manque de mouvement de caméra : Comment forcer les travellings

Vos vidéos IA sont trop statiques ? Guide pratique pour ajouter des mouvements de caméra (pan, tilt, zoom, travelling) dans vos générations vidéo.