Runway ou Sora, quelle solution IA vidéo semble la plus prometteuse ?

Runway ou Sora, analyse honnête pour créateurs débutants, contrôle caméra, cohérence temporelle, coûts de production et méthode de test.

Slug: runway-ou-sora-solution-ia-video-plus-prometteuse

Premier rendu, euphorie. Deuxième rendu, doute. Troisième rendu, panique.

C'est là que la plupart des débutants décrochent.

Vous pensiez chercher un outil magique. En réalité, vous avez besoin d'une méthode de plateau, adaptée à l'IA.

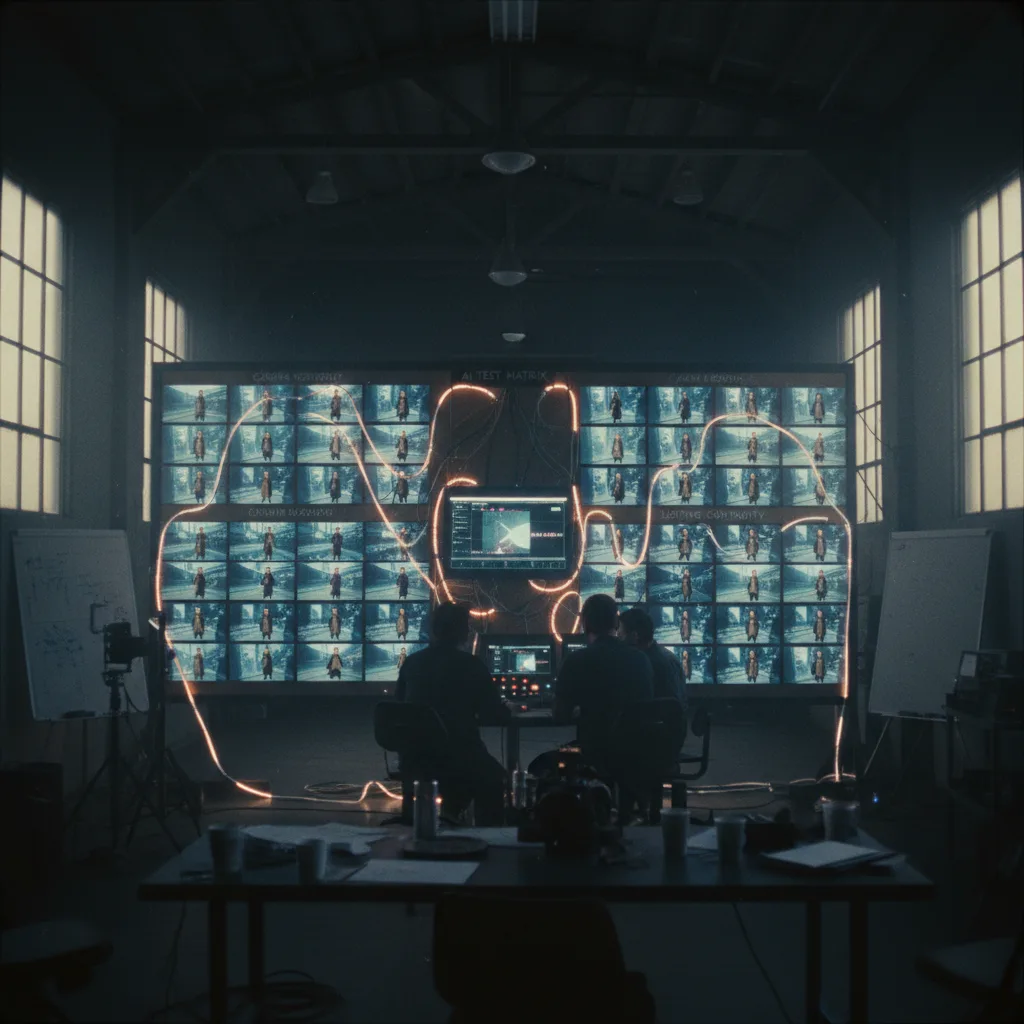

Dans un tournage traditionnel, personne ne tourne un personnage principal sans bible costume, référence maquillage, et continuité photo. En IA, c'est exactement la même logique. La seule différence, c'est la vitesse de génération, pas les fondamentaux de direction artistique.

Ce que vous appelez souvent "incohérence" n'est pas un bug mystérieux. C'est le résultat de décisions non verrouillées. Formulation ambiguë, ordre de prompt instable, paramètres qui changent d'une itération à l'autre, absence de contrôle de seed, puis panique en post-production.

Voici pourquoi cela vous bloque, vous perdez du temps au mauvais endroit. Vous corrigez tard ce qui devait être décidé tôt. Vous retouchez des symptômes au lieu de réparer la cause.

Pensez comme un assistant réalisateur. D'abord vous verrouillez la fiche personnage, ensuite seulement vous multipliez les plans. C'est contre-intuitif au début, mais c'est ce qui transforme un flux chaotique en pipeline professionnel.

Runway ou Sora, prometteur veut dire quoi en production réelle

Dans la vidéo IA, le piège classique est de juger un modèle sur une démo virale. Ce n'est pas un protocole de production. Vous devez regarder la stabilité temporelle, le contrôle caméra, la gestion des transitions, le coût de correction en montage, et la vitesse de livraison.

Runway est souvent apprécié pour son écosystème orienté créateurs, avec des fonctions directement utiles en pipeline. Sora attire par sa promesse visuelle et ses perspectives. Mais votre décision ne doit pas être émotionnelle.

Adoptez une grille de test simple, même script de 8 secondes, même intention de caméra, même niveau de mouvement, même exigence de cohérence. Puis mesurez le nombre de plans réellement exploitables sans chirurgie en post.

| Critère terrain | Runway | Sora | Décision pratique |

|---|---|---|---|

| Contrôle caméra | Souvent plus accessible | Variable selon accès/fonctions | Priorité au contrôle si deadline courte |

| Cohérence temporelle | Bonne selon cas d'usage | Potentiellement très forte, à vérifier | Tester sur scènes complexes |

| Intégration workflow | Mature pour créateurs | En évolution | Regardez votre stack actuelle |

| Coût de correction | Modéré si planifié | Peut varier fortement | Mesurez le temps, pas l'effet wow |

| Livraison client | Prévisible avec méthode | Dépend du contexte d'usage | Sécurisez vos marges |

Scénarios réalistes, les situations qui vous attendent vraiment

Scénario 1, vous livrez une campagne locale et le client valide une première image, puis rejette les suivantes car le visage change subtilement. Votre délai est de 48 heures.Scénario 2, vous montez une mini-série en six épisodes. Le personnage passe d'un plan large de jour à un gros plan nocturne. Sans continuité, l'illusion s'effondre.

Scénario 3, vous devez décliner un même héros sur 12 visuels social media et print. Le moindre glissement de texture ou de silhouette coûte des heures de corrections.

Workflow pratique, clic par clic, version débutant sérieuse

- Créer une fiche personnage exploitable, ouvrez un document simple, Notion, Google Doc, ou markdown local. Définissez 12 attributs fixes, âge apparent, forme du visage, texture de peau, coupe de cheveux, palette de vêtements, accessoires autorisés, posture dominante, trois émotions canoniques, ratio visuel principal, niveau de réalisme, et défauts à éviter.

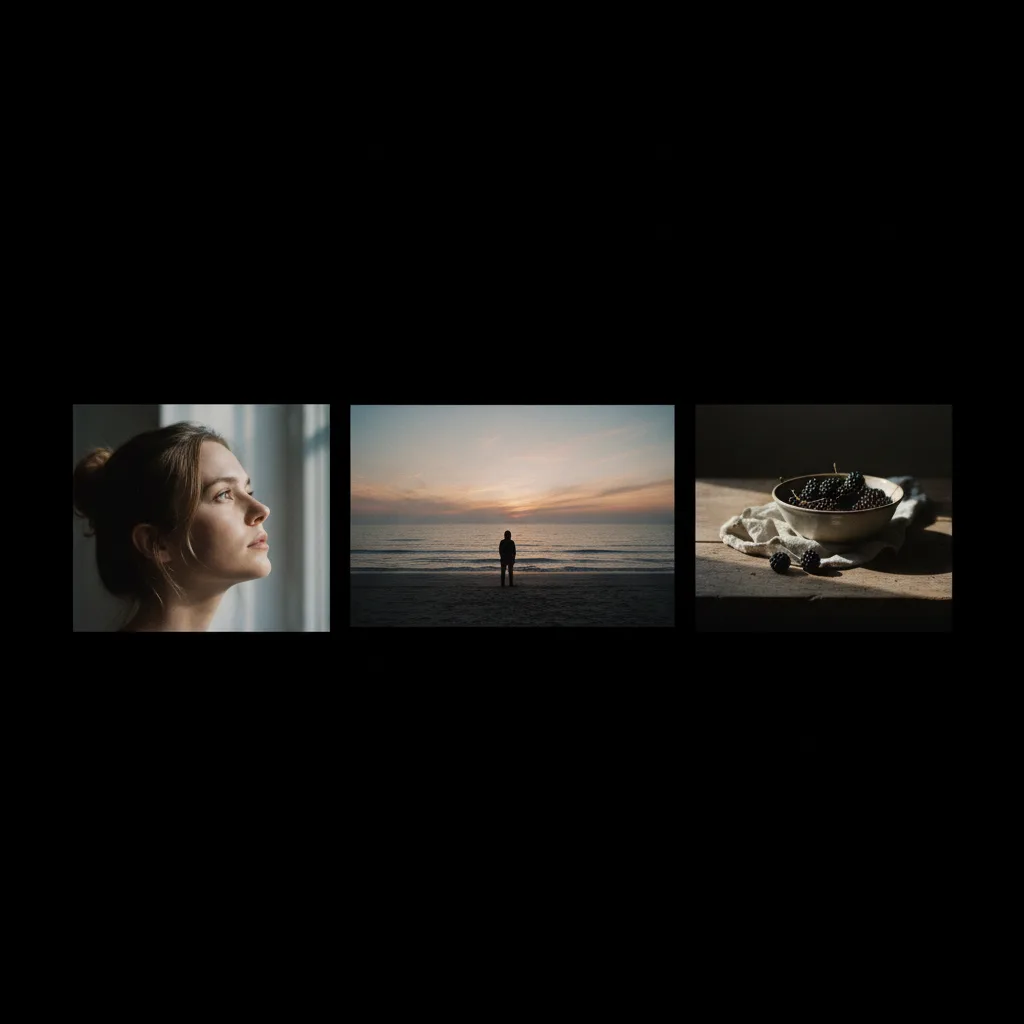

- Produire vos cinq images maîtres, générez un frontal, un profil, un trois-quarts, un plan poitrine, et un plan plus large. Gardez le même seed pendant cette phase. Éliminez sans pitié toute variante qui dérive anatomiquement.

- Construire un prompt noyau, placez l'identité du personnage en premier, puis la caméra, ensuite la lumière, puis la scène. Cet ordre est vital. Si vous mettez la scène avant le personnage, le modèle priorise souvent l'environnement.

- Créer un test de robustesse, lancez 30 générations avec changements contrôlés, jour, nuit, intérieur, extérieur, plan serré, plan large, émotion neutre, émotion intense. Comptez les sorties hors-charte.

- Industrialiser en presets, créez des blocs réutilisables,

hero_closeup,hero_motion,hero_dialogue,hero_night, avec leurs paramètres associés. - Préparer la livraison multi-formats, testez tôt en 1:1, 4:5, 9:16, 16:9. Une direction visuelle solide survit au recadrage.

Checklist de réglages qui évite les erreurs coûteuses

| Paramètre | Réglage de départ | Mauvais réflexe | Impact final |

|---|---|---|---|

| Ratio | --ar 16:9 ou --ar 2:3 puis stable | Changer de ratio à chaque test | Continuite cassée |

| Seed | Fixe pendant la phase critique | Laisser aléatoire | Variabilité inutile |

| Référence image | 3 à 5 masters validées | Référence faible unique | Dérive rapide |

| Stylisation | Niveau modéré | Stylisation extrême trop tôt | Peau plastique |

| Négatifs | 5 à 8 exclusions utiles | Liste contradictoire interminable | Artefacts |

| Lumière | Schéma simple constant | Lumière improvisée | Rendu amateur |

Ici, le but est simple, réduire le bruit, augmenter la répétabilité.

Trench warfare, ce que les débutants ratent, et comment corriger exactement

Vous voulez la version terrain. Pas la version brochure.Erreur 1, le visage dérive sur une série de rendus

Cause réelle, votre prompt décrit une ambiance, pas une anatomie. Vous dites "cinématographique" ou "épique", mais vous oubliez la structure du visage. Correction, écrivez trois descripteurs anatomiques non négociables, fixez un seed pour la phase critique, et travaillez avec vos images maîtres en référence.Erreur 2, rendu plastique et sans émotion

Cause réelle, stylisation trop agressive et peau trop lissée. Correction, baissez la stylisation, ajoutez texture réaliste, pores, micro-contraste, léger grain film, et une logique de lumière simple, key, fill, back.Erreur 3, mouvement robotique en vidéo

Cause réelle, vous demandez une action complète en une seule génération. Correction, découpez en beats, intention unique par plan, puis interpolation. Votre clip devient lisible.Erreur 4, costume instable

Cause réelle, garde-robe implicite. Correction, définissez trois variantes maximum de tenue autorisée. Tout le reste est bloqué.Erreur 5, texte illisible dans l'image

Cause réelle, outil non spécialisé pour la typographie. Correction, gardez l'image propre, puis intégrez le texte en post-production, ou passez sur un outil pensé pour texte-dans-image.Erreur 6, vous changez d'outil à chaque frustration

Cause réelle, absence de protocole de test. Correction, gardez le même pipeline pendant une semaine, journalisez les changements, et comparez à froid.

Ressource vidéo recommandée pour visualiser la méthode

Je recommande cette vidéo avant votre prochaine session, vous verrez un enchaînement concret, du prompt initial à la sélection finale, avec des itérations commentées plan par plan: https://www.youtube.com/watch?v=6OMD4f4V6xQMaillage interne, pour progresser plus vite sans repartir de zéro

Quand vous avancez dans ce type de projet, je vous conseille de garder ces ressources internes ouvertes, la méthode de pré-production visuelle dans ce workflow de storyboards IA pour cadrer un projet dès la première version, la prise en main image dans ce tutoriel concret pour débuter sur Midjourney et DALL·E sans se disperser, la comparaison vidéo dans ce comparatif détaillé des générateurs vidéo IA selon les contraintes réelles de production, et la stabilisation finale dans cette méthode technique pour corriger le flickering avant livraison client.Ressource externe utile

Lisez aussi Runway Research, pour vérifier les limites officielles et adapter votre workflow avec des informations à jour.Foire aux questions

Comment garder exactement le même personnage sur 50 images ?

Commencez par cinq images maîtres, un prompt noyau stable, et un seed verrouillé pendant la phase de continuité.Dois-je écrire des prompts très longs pour avoir un meilleur résultat ?

Non. Un prompt clair, hiérarchisé et sans contradiction fonctionne mieux qu'une longue phrase confuse.Quand faut-il retoucher dans Photopea ou Photoshop ?

Après avoir stabilisé la source. La retouche est la finition, pas la béquille d'un prompt mal construit.Comment savoir si mon rendu est vraiment professionnel ?

Vérifiez quatre points, anatomie stable, lumière cohérente, texture crédible, intention lisible en moins d'une seconde.Quel est le meilleur réflexe quand le client dit "ce n'est pas la même personne" ?

Ne défendez pas l'image. Revenez à la fiche personnage, montrez les écarts précis, corrigez le noyau, puis régénérez.Combien de temps pour obtenir un workflow fiable ?

En général, trois à cinq sessions sérieuses suffisent pour poser une méthode stable.Dans un tournage traditionnel, personne ne tourne un personnage principal sans bible costume, référence maquillage, et continuité photo. En IA, c'est exactement la même logique. La seule différence, c'est la vitesse de génération, pas les fondamentaux de direction artistique.

Ce que vous appelez souvent "incohérence" n'est pas un bug mystérieux. C'est le résultat de décisions non verrouillées. Formulation ambiguë, ordre de prompt instable, paramètres qui changent d'une itération à l'autre, absence de contrôle de seed, puis panique en post-production.

Voici pourquoi cela vous bloque, vous perdez du temps au mauvais endroit. Vous corrigez tard ce qui devait être décidé tôt. Vous retouchez des symptômes au lieu de réparer la cause.

Pensez comme un assistant réalisateur. D'abord vous verrouillez la fiche personnage, ensuite seulement vous multipliez les plans. C'est contre-intuitif au début, mais c'est ce qui transforme un flux chaotique en pipeline professionnel.

Ce point paraît répétitif, mais c'est volontaire, en production, la constance gagne toujours contre l'improvisation.

Dans un tournage traditionnel, personne ne tourne un personnage principal sans bible costume, référence maquillage, et continuité photo. En IA, c'est exactement la même logique. La seule différence, c'est la vitesse de génération, pas les fondamentaux de direction artistique.

Ce que vous appelez souvent "incohérence" n'est pas un bug mystérieux. C'est le résultat de décisions non verrouillées. Formulation ambiguë, ordre de prompt instable, paramètres qui changent d'une itération à l'autre, absence de contrôle de seed, puis panique en post-production.

Voici pourquoi cela vous bloque, vous perdez du temps au mauvais endroit. Vous corrigez tard ce qui devait être décidé tôt. Vous retouchez des symptômes au lieu de réparer la cause.

Pensez comme un assistant réalisateur. D'abord vous verrouillez la fiche personnage, ensuite seulement vous multipliez les plans. C'est contre-intuitif au début, mais c'est ce qui transforme un flux chaotique en pipeline professionnel.

Ce point paraît répétitif, mais c'est volontaire, en production, la constance gagne toujours contre l'improvisation.

Dans un tournage traditionnel, personne ne tourne un personnage principal sans bible costume, référence maquillage, et continuité photo. En IA, c'est exactement la même logique. La seule différence, c'est la vitesse de génération, pas les fondamentaux de direction artistique.

Ce que vous appelez souvent "incohérence" n'est pas un bug mystérieux. C'est le résultat de décisions non verrouillées. Formulation ambiguë, ordre de prompt instable, paramètres qui changent d'une itération à l'autre, absence de contrôle de seed, puis panique en post-production.

Voici pourquoi cela vous bloque, vous perdez du temps au mauvais endroit. Vous corrigez tard ce qui devait être décidé tôt. Vous retouchez des symptômes au lieu de réparer la cause.

Pensez comme un assistant réalisateur. D'abord vous verrouillez la fiche personnage, ensuite seulement vous multipliez les plans. C'est contre-intuitif au début, mais c'est ce qui transforme un flux chaotique en pipeline professionnel.

Ce point paraît répétitif, mais c'est volontaire, en production, la constance gagne toujours contre l'improvisation.

Dans un tournage traditionnel, personne ne tourne un personnage principal sans bible costume, référence maquillage, et continuité photo. En IA, c'est exactement la même logique. La seule différence, c'est la vitesse de génération, pas les fondamentaux de direction artistique.

Ce que vous appelez souvent "incohérence" n'est pas un bug mystérieux. C'est le résultat de décisions non verrouillées. Formulation ambiguë, ordre de prompt instable, paramètres qui changent d'une itération à l'autre, absence de contrôle de seed, puis panique en post-production.

Voici pourquoi cela vous bloque, vous perdez du temps au mauvais endroit. Vous corrigez tard ce qui devait être décidé tôt. Vous retouchez des symptômes au lieu de réparer la cause.

Pensez comme un assistant réalisateur. D'abord vous verrouillez la fiche personnage, ensuite seulement vous multipliez les plans. C'est contre-intuitif au début, mais c'est ce qui transforme un flux chaotique en pipeline professionnel.

Ce point paraît répétitif, mais c'est volontaire, en production, la constance gagne toujours contre l'improvisation.

Dans un tournage traditionnel, personne ne tourne un personnage principal sans bible costume, référence maquillage, et continuité photo. En IA, c'est exactement la même logique. La seule différence, c'est la vitesse de génération, pas les fondamentaux de direction artistique.

Ce que vous appelez souvent "incohérence" n'est pas un bug mystérieux. C'est le résultat de décisions non verrouillées. Formulation ambiguë, ordre de prompt instable, paramètres qui changent d'une itération à l'autre, absence de contrôle de seed, puis panique en post-production.

Voici pourquoi cela vous bloque, vous perdez du temps au mauvais endroit. Vous corrigez tard ce qui devait être décidé tôt. Vous retouchez des symptômes au lieu de réparer la cause.

Pensez comme un assistant réalisateur. D'abord vous verrouillez la fiche personnage, ensuite seulement vous multipliez les plans. C'est contre-intuitif au début, mais c'est ce qui transforme un flux chaotique en pipeline professionnel.

Ce point paraît répétitif, mais c'est volontaire, en production, la constance gagne toujours contre l'improvisation.

Dans un tournage traditionnel, personne ne tourne un personnage principal sans bible costume, référence maquillage, et continuité photo. En IA, c'est exactement la même logique. La seule différence, c'est la vitesse de génération, pas les fondamentaux de direction artistique.

Ce que vous appelez souvent "incohérence" n'est pas un bug mystérieux. C'est le résultat de décisions non verrouillées. Formulation ambiguë, ordre de prompt instable, paramètres qui changent d'une itération à l'autre, absence de contrôle de seed, puis panique en post-production.

Voici pourquoi cela vous bloque, vous perdez du temps au mauvais endroit. Vous corrigez tard ce qui devait être décidé tôt. Vous retouchez des symptômes au lieu de réparer la cause.

Pensez comme un assistant réalisateur. D'abord vous verrouillez la fiche personnage, ensuite seulement vous multipliez les plans. C'est contre-intuitif au début, mais c'est ce qui transforme un flux chaotique en pipeline professionnel.

Ce point paraît répétitif, mais c'est volontaire, en production, la constance gagne toujours contre l'improvisation.

Dans un tournage traditionnel, personne ne tourne un personnage principal sans bible costume, référence maquillage, et continuité photo. En IA, c'est exactement la même logique. La seule différence, c'est la vitesse de génération, pas les fondamentaux de direction artistique.

Ce que vous appelez souvent "incohérence" n'est pas un bug mystérieux. C'est le résultat de décisions non verrouillées. Formulation ambiguë, ordre de prompt instable, paramètres qui changent d'une itération à l'autre, absence de contrôle de seed, puis panique en post-production.

Voici pourquoi cela vous bloque, vous perdez du temps au mauvais endroit. Vous corrigez tard ce qui devait être décidé tôt. Vous retouchez des symptômes au lieu de réparer la cause.

Pensez comme un assistant réalisateur. D'abord vous verrouillez la fiche personnage, ensuite seulement vous multipliez les plans. C'est contre-intuitif au début, mais c'est ce qui transforme un flux chaotique en pipeline professionnel.

Ce point paraît répétitif, mais c'est volontaire, en production, la constance gagne toujours contre l'improvisation.

Ressource externe recommandee

Prompt Engineering Guide, exemples pratiques et bonnes pratiques

Le meilleur resultat vient d'un workflow simple, teste, puis repete avec des ajustements concrets.

Votre avis

Chargement…

Sur le même thème sur ce site

Ces guides prolongent l’article sans répéter le même angle. Ils renforcent le maillage interne et aident à explorer le sujet en profondeur.

Voir tous les articles « Vidéo IA »

- Meilleures IA pour créer des vidéos

- Tutoriels vidé IA avancés

- Workflow débutant, de l’idée à la vidéo

- Panorama des outils IA

Articles proches sur le blog

Suggestions basées sur la catégorie, les mots du titre et le sujet, pour prolonger la lecture sans dupliquer les piliers ci-dessus.

- La technique du Video-to-Video expliquée : Runway Gen-5 et au-delà

- Transformer une vidéo de jour en vidéo de nuit grâce aux filtres IA

- Quel format vidéo (16:9, 9:16, 1:1) générer selon la plateforme visée ?

- Face Swap en vidéo : remplacer un visage facilement (et légalement)

Sources et cadre officiel (lectures externes)

Renseignements généraux, droit et bonnes pratiques publiés par des institutions. À consulter selon votre situation et votre juridiction.

Frank Houbre - expert IA vidéo et Image

Frank Houbre est un expert en IA vidéo et image, artiste IA et filmmaker récompensé aux Seoul International AI Film Festival et aux Mondial Chroma Awards. Avec plus de 10 ans d'expérience en entrepreneuriat digital, il crée des courts-métrages et animés entièrement générés par IA (Midjourney, Kling, Adobe Firefly). Co-Fondateur de Screenweaver et de la communauté #AIStudios, il partage des tutoriels gratuits et avis d'outils sur Business Dynamite pour aider les créateurs à automatiser leur production.

Continuer la lecture

La technique du Video-to-Video expliquée : Runway Gen-5 et au-delà

Comprendre le Video-to-Video (V2V) de Runway Gen-5 et des autres moteurs : principe, workflow pas à pas et pièges à éviter pour un rendu pro.

Transformer une vidéo de jour en vidéo de nuit grâce aux filtres IA

Tu as tourné ou généré une vidéo en plein jour et tu veux une ambiance nuit. Étalonnage, LUT et filtres IA : quels outils, quels réglages, et comment éviter le rendu artificiel.

Quel format vidéo (16:9, 9:16, 1:1) générer selon la plateforme visée ?

Choisir le bon ratio vidéo (paysage, vertical, carré) selon YouTube, TikTok, Instagram, LinkedIn et les outils IA.

Face Swap en vidéo : remplacer un visage facilement (et légalement)

Remplacer un visage dans une vidéo avec l'IA : quels outils, quel workflow, et comment rester dans le cadre légal (droit à l'image, mention IA).

Générer une vidéo de 5 secondes à partir d'un simple texte : par où commencer ?

Tu as une phrase en tête et tu veux en faire un clip de 5 secondes. Text-to-video pour débutants : quel outil, quel prompt, quels réglages, et le premier fichier sur ton disque en moins de 10 minutes.

L'interface de Runway Gen-3 expliquée aux débutants

Tu ouvres Runway pour la première fois et tu ne sais pas où cliquer. Ce guide décortique l'interface Gen-3 : où est le prompt, l'image-to-video, les paramètres, et comment ne rien rater.