De l'idée brute au rendu final : étude de cas étape par étape

Étude de cas complète : comment transformer une idée vague en vidéo IA finie, du brief initial au fichier exporté, avec chaque décision détaillée.

"J'ai une idée de vidéo mais je ne sais pas par où commencer." C'est la phrase que j'entends le plus. Pas "je ne sais pas prompter". Pas "je ne connais pas les outils". Non. Le vrai blocage, c'est le passage entre ce qu'on a dans la tête et ce qui existe sur un écran. Entre l'intuition et le fichier .mp4.

Les tutoriels te montrent comment utiliser Runway. Comment écrire un prompt pour Midjourney. Comment monter sur CapCut. Mais ils ne te montrent presque jamais le chemin complet. Du moment où tu griffonnes une idée sur un bout de papier jusqu'au moment où tu exportes ta vidéo. C'est ce chemin qu'on va parcourir ici, intégralement, à travers une étude de cas fictive mais basée sur des situations réelles que je rencontre en production.

On ne va pas survoler. On va ouvrir chaque porte, détailler chaque choix, et surtout expliquer pourquoi on prend telle décision plutôt qu'une autre.

Pour aller plus loin avec une demonstration pratique, cette video est directement liee au sujet.

Générer des Images IA : Le Guide COMPLET pour Débuter

Le brief : une idée qui tient en trois phrases

Voici le projet. Tu es un créateur indépendant. Un ami restaurateur t'a demandé une vidéo promotionnelle de 30 secondes pour son nouveau restaurant. Budget : zéro (il paie en repas). Contrainte : la vidéo doit donner envie, montrer l'ambiance du lieu, et finir sur le nom du restaurant. Pas d'acteurs disponibles. Pas de caméra. Juste toi, ton ordinateur, et les outils IA.

C'est un cas typique. Pas un court-métrage expérimental. Pas une pub pour une multinationale. Un projet concret, petit, avec des contraintes réelles.

Ton idée brute : "Plans du restaurant le soir, lumière chaude, cuisine, plats, ambiance intime. Musique douce. Logo à la fin."

C'est vague. C'est normal. Toutes les idées commencent vagues. La question, c'est comment structurer cette intuition pour que l'IA puisse la comprendre et la rendre.

Phase 1 : Écrire le script et le découpage

Transformer l'idée en script écrit

Avant de toucher un seul générateur d'images ou de vidéo, tu écris. Pas un scénario de long-métrage. Un document de 10 à 15 lignes qui décrit chaque plan, dans l'ordre, avec l'action et le cadrage.

Ouvre ChatGPT (ou Claude, ou Gemini). Voici le prompt que tu utilises :

Tu es un réalisateur publicitaire. Écris un découpage technique pour une vidéo promotionnelle de 30 secondes pour un restaurant gastronomique. Ambiance : soirée, lumière chaude, intime. Pas d'acteurs, seulement des plans de l'intérieur, de la cuisine et des plats. 6 plans maximum. Pour chaque plan, indique : numéro, durée, cadrage (gros plan, plan moyen, plan large), description de l'image, mouvement de caméra éventuel.

Le LLM te renvoie quelque chose comme :

| Plan | Durée | Cadrage | Description | Mouvement |

|---|---|---|---|---|

| 1 | 4 s | Plan large | Salle du restaurant vue de l'entrée, tables dressées, bougies allumées, lumière tamisée dorée | Travelling avant lent |

| 2 | 5 s | Gros plan | Main du chef qui dépose une sauce sur une assiette, vapeur visible | Fixe |

| 3 | 5 s | Plan moyen | Deux verres de vin rouge sur une table en bois, reflets des bougies | Léger pan vers la droite |

| 4 | 5 s | Gros plan | Plat gastronomique vu du dessus, herbes fraîches, texture visible | Fixe, légèrement plongeant |

| 5 | 5 s | Plan large | Cuisine ouverte, flammes du fourneau, silhouette du chef en mouvement | Travelling latéral |

| 6 | 6 s | Plan moyen | Façade du restaurant la nuit, enseigne lumineuse, nom lisible, rue calme | Fixe, zoom lent |

Six plans. Trente secondes. Chaque plan a un rôle précis. Tu ne génères pas "des images de restaurant" au hasard. Tu sais exactement ce que tu cherches pour chaque moment de la vidéo.

En cinéma traditionnel, personne ne filme sans découpage. En IA, c'est pareil. Le découpage technique est ta boussole. Sans lui, tu dérives.

Affiner avec le bon niveau de détail

Le tableau ci-dessus est un point de départ. Tu le retravailles à la main. Plan 2, "main du chef qui dépose une sauce" : est-ce une main masculine, féminine ? Quelle sauce, quelle couleur ? Le tablier est blanc ou noir ? Ces détails comptent pour le prompt. Plus tu es précis dans ton découpage, moins tu itères dans le générateur.

Pour les débutants qui ne savent pas encore structurer un découpage, le workflow en 5 étapes de l'idée à la vidéo finale pose les bases de cette méthode.

Phase 2 : Définir le style guide

Tu as ton découpage. Maintenant, tu verrouilles le style visuel. Ça veut dire : lumière, palette de couleurs, focale, grain, et mots-clés communs à tous tes prompts.

Pour le restaurant, voici ton style guide :

- Lumière : warm key light, candle-like, soft shadows

- Palette : golden, amber, dark wood tones, deep burgundy accents

- Focale : 50mm (naturel, légèrement serré)

- Rendu : cinematic stills, cinema photography, film grain, shallow depth of field

- Interdits : pas de néon, pas de lumière froide, pas de rendu plastique

Ces termes apparaîtront dans chaque prompt, sans exception. C'est le "squelette" dont parlent les pros du batch prompting pour les campagnes en agence. Tu ne changes que le sujet et le cadrage entre les plans. Le reste est figé.

Écris ce style guide dans un document séparé. Copie-colle-le dans chaque prompt. C'est la seule façon de garantir que tes 6 plans auront l'air de venir de la même vidéo.

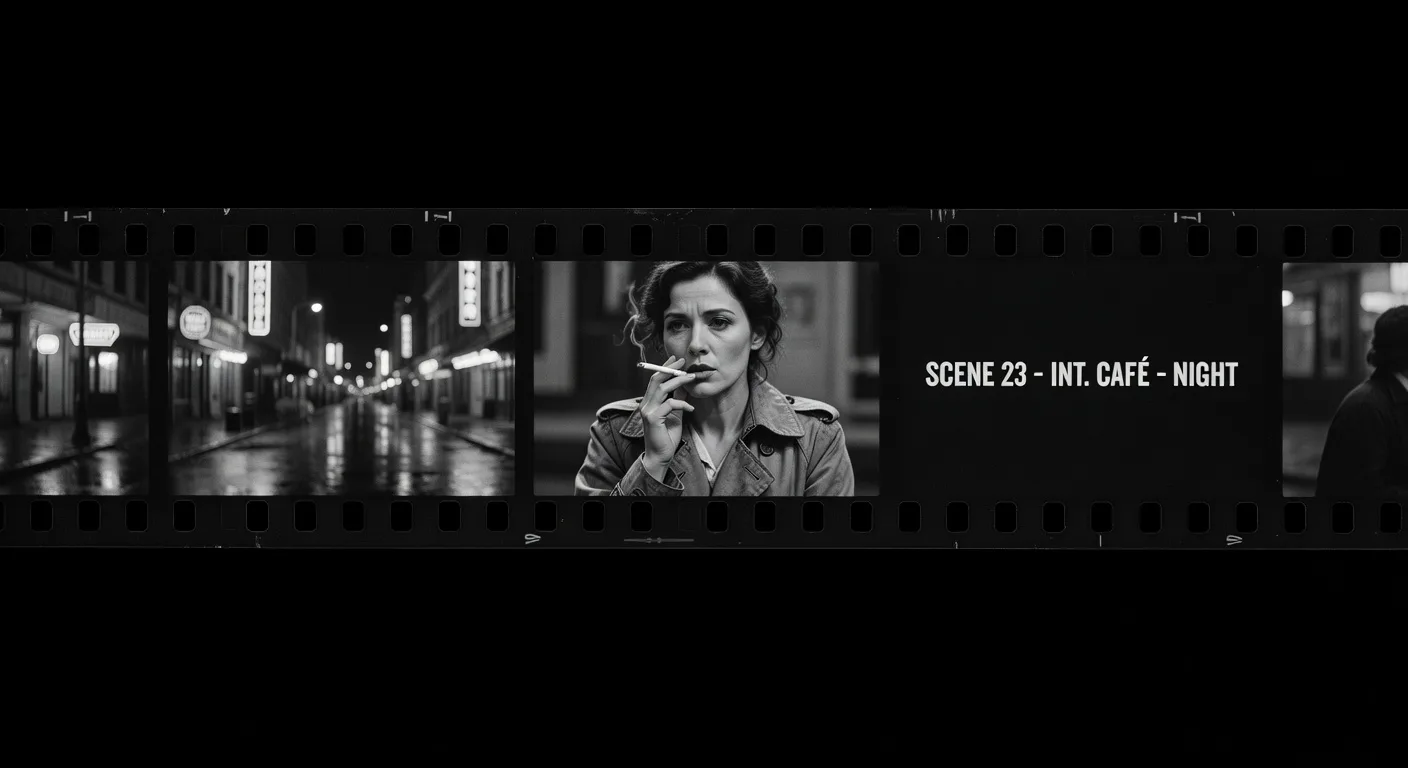

Phase 3 : Générer les concept arts (storyboard visuel)

Avant de générer de la vidéo (qui coûte des crédits et prend du temps), tu génères des images fixes. C'est ton storyboard visuel. Une image par plan, pour valider le style, le cadrage et l'ambiance avant d'engager des ressources vidéo.

Construire les prompts image

Tu prends le style guide et tu ajoutes la description de chaque plan. Voici les 6 prompts :

Plan 1 :

Restaurant dining room seen from entrance, tables set with white linen, candles lit, warm golden ambient light, 50mm, cinematic stills, cinema photography, film grain, shallow depth of field, no text, no person face visible.

Plan 2 :

Close-up of chef's hand placing sauce on a white plate, steam rising, dark apron, warm key light from left, 50mm, cinematic stills, cinema photography, film grain, shallow depth of field, no text.

Plan 3 :

Two glasses of red wine on dark wooden table, candle reflections on glass surface, warm amber light, 50mm, cinematic stills, cinema photography, film grain, shallow depth of field, no text.

Plan 4 :

Overhead shot of gourmet dish on dark plate, fresh herbs, visible texture of sauce and meat, warm light from upper right, 50mm, cinematic stills, cinema photography, film grain, no text.

Plan 5 :

Open kitchen with gas flames on stove, silhouette of chef in motion, warm orange light, slight smoke, wide shot, 50mm, cinematic stills, cinema photography, film grain, no text.

Plan 6 :

Restaurant facade at night, glowing sign with restaurant name, calm street, warm light from inside windows, 50mm, cinematic stills, cinema photography, film grain, no text.

Tu lances ces prompts dans Midjourney, Flux ou DALL-E 3. Tu obtiens 6 images. Tu les mets côte à côte. Est-ce que ça ressemble à la même vidéo ? La palette est-elle cohérente ? La lumière va dans le même sens ? Si un plan détonne (trop froid, trop lumineux, mauvais cadrage), tu ajustes le prompt et tu relances ce plan-là uniquement.

Valider avant de passer à la vidéo

C'est le moment de montrer le storyboard à ton ami restaurateur. Six images. L'ordre des plans. L'ambiance. Il valide ou il demande des ajustements ("la salle est trop sombre", "je voudrais voir plus le plat signature"). Tu corriges maintenant, sur des images qui se génèrent en 30 secondes, pas plus tard sur des vidéos qui prennent 2 minutes chacune et coûtent 10 crédits.

En cinéma traditionnel, personne ne tourne avant que le storyboard soit approuvé. C'est la même logique ici. Créer le storyboard de sa première vidéo IA de A à Z détaille cette étape pour ceux qui veulent aller plus loin.

Phase 4 : Passer à la génération vidéo

Le storyboard est validé. Les 6 images sont prêtes. Tu passes à la vidéo.

Choisir l'outil et le mode

Tu as deux approches possibles :

| Approche | Outil type | Avantage | Limite |

|---|---|---|---|

| Text-to-Video | Runway Gen-4, Kling 2.0, Sora | Liberté totale, pas besoin d'image | Cohérence aléatoire entre les plans |

| Image-to-Video | Runway (Image-to-Video), Kling (Motion) | Part de ton concept art validé, cohérence visuelle forte | Mouvement parfois limité ou artificiel |

Pour notre projet restaurant, Image-to-Video est le bon choix. Tu as déjà 6 images validées. Tu pars de là. Le résultat sera visuellement cohérent avec ton storyboard.

Générer plan par plan

Ouvre Runway (ou l'outil de ton choix). Mode Image-to-Video. Uploade l'image du Plan 1. Dans le champ de prompt, décris le mouvement :

- Plan 1 :

Slow dolly forward through restaurant dining room, candles flickering, warm light - Plan 2 :

Steady shot, chef's hand slowly drizzles sauce, steam rises gently - Plan 3 :

Subtle camera pan right, wine glasses stay sharp, candle light dances on surface - Plan 4 :

Static overhead shot, slight focus shift from herbs to center of plate - Plan 5 :

Slow lateral tracking shot, flames dance on stove, chef silhouette moves - Plan 6 :

Gentle zoom in on restaurant sign, warm glow from windows intensifies slightly

Paramètres clés :

- Durée : 4 à 6 secondes par plan (total = ~30 s)

- Résolution : 1280×720 minimum (upscale ensuite si nécessaire)

- Ratio : 16:9

Résultat attendu : 6 clips vidéo de 4 à 6 secondes. Certains seront bons du premier coup. D'autres nécessiteront 2 ou 3 relances. Prévois 15 à 20 générations au total pour obtenir 6 plans satisfaisants.

Le premier rendu ne sera presque jamais parfait. C'est normal. La génération vidéo IA est un processus itératif, pas un bouton magique. Ce qui te sauve du temps, c'est de partir d'une image validée plutôt que de tout laisser au hasard.

Phase 5 : Le montage, la cohérence et le son

Tu as tes 6 clips. Maintenant, tu assembles.

Importer dans le logiciel de montage

Ouvre CapCut (gratuit, simple) ou DaVinci Resolve (gratuit, pro). Importe tes 6 clips dans l'ordre du découpage. Place-les sur la timeline.

Premières vérifications :

- La durée totale est-elle autour de 30 secondes ? Si tu dépasses, raccourcis les plans les moins forts.

- Les transitions entre les plans sont-elles fluides ? Si le Plan 2 (gros plan sauce) arrive après le Plan 1 (salle large) de façon trop brutale, ajoute un fondu enchaîné de 0,5 seconde. Pas plus, sinon ça fait amateur.

- La colorimétrie est-elle homogène ? Même avec le même style guide, des variations subtiles existent entre les clips générés. Applique un LUT (Look Up Table) identique sur tous les plans, ou ajuste manuellement la balance des couleurs dans l'onglet "Color" de DaVinci Resolve.

Pour les problèmes de raccords entre plans générés par IA, le guide sur les raccords au montage vidéo IA couvre les solutions en détail.

Ajouter le son

Une vidéo sans son, c'est une photo qui bouge. Le son fait 50 % de l'émotion.

Pour ce projet restaurant, tu as besoin de :

- Musique de fond : un morceau instrumental doux, acoustique ou jazz léger. Génère-le avec Suno ou Udio (prompt :

soft jazz instrumental, acoustic guitar, warm evening ambiance, 30 seconds, no vocals). Ou utilise une piste libre de droits depuis Epidemic Sound ou Artlist. - Bruitages : le crépitement des flammes (Plan 5), le son d'un verre qu'on pose (Plan 3), le son de la sauce versée (Plan 2). Tu peux les générer avec ElevenLabs Sound Effects ou les trouver dans une banque de bruitages gratuite (Freesound.org).

- Mixage : musique en fond continu, bruitages ponctuels synchronisés avec l'action. Baisse la musique de 3 à 6 dB quand un bruitage apparaît, pour qu'il ressorte.

Ajouter le texte final

Plan 6 : le nom du restaurant apparaît. Tu peux l'ajouter en post-production avec une animation de texte simple dans CapCut ou DaVinci. Police élégante, serif, blanc sur fond sombre. Apparition en fondu, 2 secondes. Pas d'effet spectaculaire. La sobriété vend mieux que le spectacle pour un restaurant gastronomique.

Phase 6 : L'export et la livraison

Réglages d'export

- Codec : H.264 (compatible partout) ou H.265 (plus léger, même qualité)

- Résolution : 1920×1080 (Full HD), suffisant pour les réseaux sociaux et un écran en salle

- Débit : 15 à 20 Mbps pour un bon compromis poids/qualité

- Audio : AAC 320 kbps

Si tu veux un rendu 4K, upscale tes clips avant le montage avec Topaz Video AI ou un équivalent. Mais pour une vidéo de 30 secondes destinée à Instagram et à un écran en salle, le Full HD est largement suffisant.

Les livrables

Pour ton ami restaurateur, tu fournis :

- La vidéo 16:9 (YouTube, site web, écran en salle)

- Une version 9:16 (Instagram Reels, TikTok), ce qui nécessite un recadrage ou une regénération des plans au bon ratio

- Une version 1:1 (Instagram feed, Facebook)

Trois fichiers. Pas un. Le format vertical n'est pas un recadrage du horizontal, c'est une recomposition. Pour les plans larges (Plan 1, Plan 5), tu devras peut-être regénérer l'image de base en ratio 9:16 et relancer la vidéo. Pour les gros plans (Plan 2, Plan 4), un recadrage suffit souvent.

Ce que les débutants font mal à chaque étape

C'est ici que se joue la différence entre un résultat amateur et un résultat pro.

Sauter le script et foncer dans la génération. Tu ouvres Runway, tu tapes "restaurant ambiance", tu génères. Tu obtiens un plan générique. Tu en génères un autre. Pas de lien entre les deux. Tu as brûlé 10 crédits et tu n'as rien de montable. Correction : Écris toujours le découpage technique avant de lancer le moindre générateur. 15 minutes de script économisent 2 heures de générations inutiles.

Ne pas avoir de style guide. Tes 6 plans ont 6 ambiances différentes. Un est froid, un est chaud, un est surexposé, un a du grain, un est lisse. Impossible à monter ensemble. Correction : Écris 5 lignes de style guide (lumière, palette, focale, grain, interdits). Copie-les dans chaque prompt. C'est la méthode pour structurer un prompt comme un directeur artistique.

Accepter le premier résultat. Le Plan 3 a un mouvement bizarre, les verres se déforment, le vin a l'air d'être du jus de tomate. Tu le gardes parce que "ça ira bien". Non. Ça ne sera pas bien. Ce plan cassera toute la vidéo. Correction : Relance. Change un mot dans le prompt de mouvement. Essaie "subtle" au lieu de "slow". Essaie sans mouvement du tout. 3 générations de plus pour un plan qui tient, c'est un investissement, pas une perte.

Négliger le son. Tu mets une musique de fond en 10 secondes et tu exportes. Le résultat est plat. Il manque de vie. Correction : Le son demande autant de soin que l'image. 15 minutes pour trouver les bons bruitages, les placer au bon moment, ajuster les volumes. Ça double l'impact émotionnel.

Oublier les raccords. Plan 1, la lumière vient de gauche. Plan 2, elle vient de droite. Plan 3, il fait jour. L'incohérence sort le spectateur de l'immersion. Correction : Vérifie la direction de la lumière dans chaque prompt. Utilise un LUT unique au montage pour unifier la colorimétrie. Si un plan ne raccorde pas, régénère-le ou intercale un plan noir court (0,3 s) comme transition.

Ne pas préparer les formats. Tu exportes en 16:9. Ton ami te demande la version verticale pour Instagram. Tu recadres et le résultat est affreux, la moitié du plan est coupée. Correction : Pense multi-format dès le découpage. Favorise les cadrages centrés pour les plans qui devront fonctionner en vertical. Ou prévois de regénérer les plans larges en 9:16.

| Phase | Erreur fréquente | Impact | Solution |

|---|---|---|---|

| Script | Pas de découpage | Plans incohérents, temps perdu | 15 min de script = 2 h gagnées |

| Style | Pas de guide visuel | Ambiances qui ne matchent pas | 5 lignes de style copiées partout |

| Génération | Garder les mauvais plans | Vidéo finale bancale | Relancer 2-3 fois par plan |

| Son | Musique seule, pas de bruitages | Résultat plat et générique | Bruitages synchronisés + mix |

| Raccords | Lumière incohérente entre plans | Le spectateur décroche | Même direction lumière + LUT unique |

| Export | Un seul format | Inadapté aux réseaux | Préparer 16:9, 9:16, 1:1 dès le départ |

Le budget réel de ce projet

Détaillons ce que cette vidéo a coûté en temps et en argent, pour casser le mythe du "gratuit en 5 minutes".

| Poste | Temps | Coût |

|---|---|---|

| Script et découpage (ChatGPT) | 30 min | 0 € (plan gratuit) |

| Style guide | 10 min | 0 € |

| Concept arts (6 images, Midjourney) | 45 min (avec itérations) | ~2 € de crédits |

| Génération vidéo (6 plans, ~18 essais, Runway) | 2 h | ~8-12 € de crédits |

| Montage (CapCut) | 1 h | 0 € |

| Son (Suno + bruitages) | 30 min | 0-5 € |

| Export 3 formats | 15 min | 0 € |

| Total | ~5 h | ~10-19 € |

Cinq heures de travail. Moins de 20 euros. Pour une vidéo qui, en production classique (tournage, éclairagiste, chef op, monteur), aurait coûté entre 2 000 et 5 000 euros. C'est le vrai pouvoir de ces outils : pas la gratuité (rien n'est vraiment gratuit), mais le ratio qualité/coût qui était impensable il y a deux ans.

Ce que cette étude de cas enseigne

Trois leçons à retenir.

La structure bat la technique. Tu n'as pas besoin de maîtriser Runway comme un ingénieur. Tu as besoin d'un découpage clair, d'un style guide et de la discipline de suivre le plan. La technique s'apprend en faisant. La structure, c'est ce qui empêche le projet de s'écrouler.

L'IA ne remplace pas les décisions. L'IA génère. Toi, tu décides. Quel cadrage. Quelle lumière. Quel plan garder, lequel refaire. Quel bruitage à quel moment. Ces décisions sont humaines. L'IA accélère l'exécution, pas la réflexion.

Le son est la moitié du film. Si tu investis 80 % de ton temps sur l'image et 20 % sur le son, ta vidéo aura l'air à 80 % finie. Inverse le ratio de temps mental : pense au son dès le découpage.

Pour une démonstration visuelle complète d'un workflow similaire (brief, concept art, génération, montage), la vidéo tutoriel sur la transformation d'une vidéo longue en contenus courts montre un flux de production IA de bout en bout avec les vrais écrans et les vrais outils. Tu y verras les choix de plans, l'import, et le montage final.

Foire aux questions

Combien de temps faut-il pour un débutant total ?

Pour un premier projet de ce type (vidéo promo 30 secondes), compte 8 à 10 heures la première fois. Tu découvres les outils, tu tâtonnes, tu refais. Au troisième projet, tu passes sous les 5 heures. Au dixième, tu descends à 3 heures. C'est la courbe d'apprentissage normale.

Quel est le meilleur outil pour la génération vidéo en 2026 ?

Ça dépend du rendu. Runway Gen-4 offre un très bon contrôle sur le mouvement et accepte l'image-to-video de façon fiable. Kling 2.0 donne des résultats plus "organiques" sur les mouvements humains. Sora produit des plans très cinématographiques mais avec moins de contrôle fin. Pour un projet restaurant comme notre étude de cas, Runway ou Kling conviennent parfaitement.

Est-ce que je peux utiliser ces vidéos commercialement ?

Oui, dans la grande majorité des cas. Runway, Midjourney et Kling autorisent l'usage commercial sur leurs plans payants. Vérifie toujours les conditions d'utilisation de l'outil que tu utilises. Pour la musique générée (Suno, Udio), les droits commerciaux sont inclus dans les plans payants, pas dans les plans gratuits.

Comment faire si un plan ne veut pas sortir correctement après 5 essais ?

Change d'approche. Si le text-to-video ne fonctionne pas, essaie l'image-to-video avec une image de référence. Si le mouvement pose problème, génère un plan statique (sans mouvement) et ajoute un léger zoom en post-production dans ton logiciel de montage. Un plan statique bien cadré vaut mieux qu'un plan avec un mouvement raté.

Faut-il forcément passer par un storyboard image avant la vidéo ?

Techniquement non. Mais pratiquement, oui. Le storyboard te permet de valider l'ambiance, le cadrage et la cohérence avant de dépenser du temps et des crédits sur la vidéo. Sauter cette étape, c'est comme tourner sans repérages : ça peut marcher, mais ça rate plus souvent.

Comment gérer la cohérence d'un personnage qui apparaîtrait dans plusieurs plans ?

Notre étude de cas évite le problème (pas de personnage visible de face). Mais si ton projet inclut un personnage récurrent, utilise une image de référence du personnage (face, profil) dans chaque prompt. Avec Midjourney, le mode --cref (character reference) aide à maintenir la cohérence faciale. Avec Runway, pars toujours de la même image de base pour les plans qui montrent ce personnage.

Peut-on faire ce type de projet entièrement sur smartphone ?

Partiellement. Tu peux écrire le script et générer les images sur mobile (les apps Midjourney et ChatGPT existent). Pour le montage, CapCut mobile est fonctionnel. Mais pour la génération vidéo (Runway, Kling), l'interface desktop est nettement plus confortable. Un mix smartphone + ordinateur est le plus réaliste pour un débutant.

Comment s'améliorer entre le premier et le dixième projet ?

Garde un journal de tes projets. Note ce qui a marché (quel prompt, quel style guide, quels paramètres) et ce qui a raté (quel plan a nécessité le plus de relances, pourquoi). C'est exactement le principe de la bibliothèque de prompts dans Notion ou Obsidian. Chaque projet nourrit le suivant.

Votre avis

Chargement…

Sur le même thème sur ce site

Ces guides prolongent l’article sans répéter le même angle. Ils renforcent le maillage interne et aident à explorer le sujet en profondeur.

- Meilleures IA pour créer des vidéos

- Tutoriels vidé IA avancés

- Workflow débutant, de l’idée à la vidéo

- Panorama des outils IA

Sources et cadre officiel (lectures externes)

Renseignements généraux, droit et bonnes pratiques publiés par des institutions. À consulter selon votre situation et votre juridiction.

Frank Houbre - expert IA vidéo et Image

Frank Houbre est un expert en IA vidéo et image, artiste IA et filmmaker récompensé aux Seoul International AI Film Festival et aux Mondial Chroma Awards. Avec plus de 10 ans d'expérience en entrepreneuriat digital, il crée des courts-métrages et animés entièrement générés par IA (Midjourney, Kling, Adobe Firefly). Co-Fondateur de Screenweaver et de la communauté #AIStudios, il partage des tutoriels gratuits et avis d'outils sur Business Dynamite pour aider les créateurs à automatiser leur production.

Continuer la lecture

Vidéo qui tremble (Flickering) : comment stabiliser le rendu final ?

Vidéo IA qui tremble ou clignote : causes, réglages à la génération, et workflow post-production pour stabiliser le rendu final (Resolve, étalonnage, export).

Créer une publicité de 30 secondes 100 % IA : de l’idée à l’export final

Guide complet pour produire un spot de 30 secondes entièrement avec des outils IA : idée, script, génération vidéo, voix, musique, montage, export.

Astuces logicielles pour réduire le temps de rendu d'une vidéo générative

Optimisations pratiques pour accélérer vos rendus de vidéos IA. Paramètres, proxies, encodage hardware : tout ce qui fait gagner du temps sans sacrifier la qualité.

Le workflow ultime du débutant : De l'idée à la vidéo finale en 5 étapes

Vous avez une idée. Vous voulez une vidéo. Pas de flou : 5 étapes claires, de la synopsis à l'export, avec l'IA à chaque maillon.

Mises à jour des algorithmes Meta et TikTok : pourquoi la vidéo IA brute est de plus en plus pénalisée

Meta et TikTok pénalisent de plus en plus la vidéo IA non retravaillée. Comprendre les signaux, adapter ton workflow et garder la portée.

Upscaling vidéo IA : passer de la génération 720p au rendu 4K professionnel

Agrandir et améliorer des vidéos IA en 720p pour un rendu 4K : outils, paramètres et pièges à éviter pour un résultat pro.